Claude 封号限流砍权益,OpenAI 趁机用 Codex 稳稳接住你

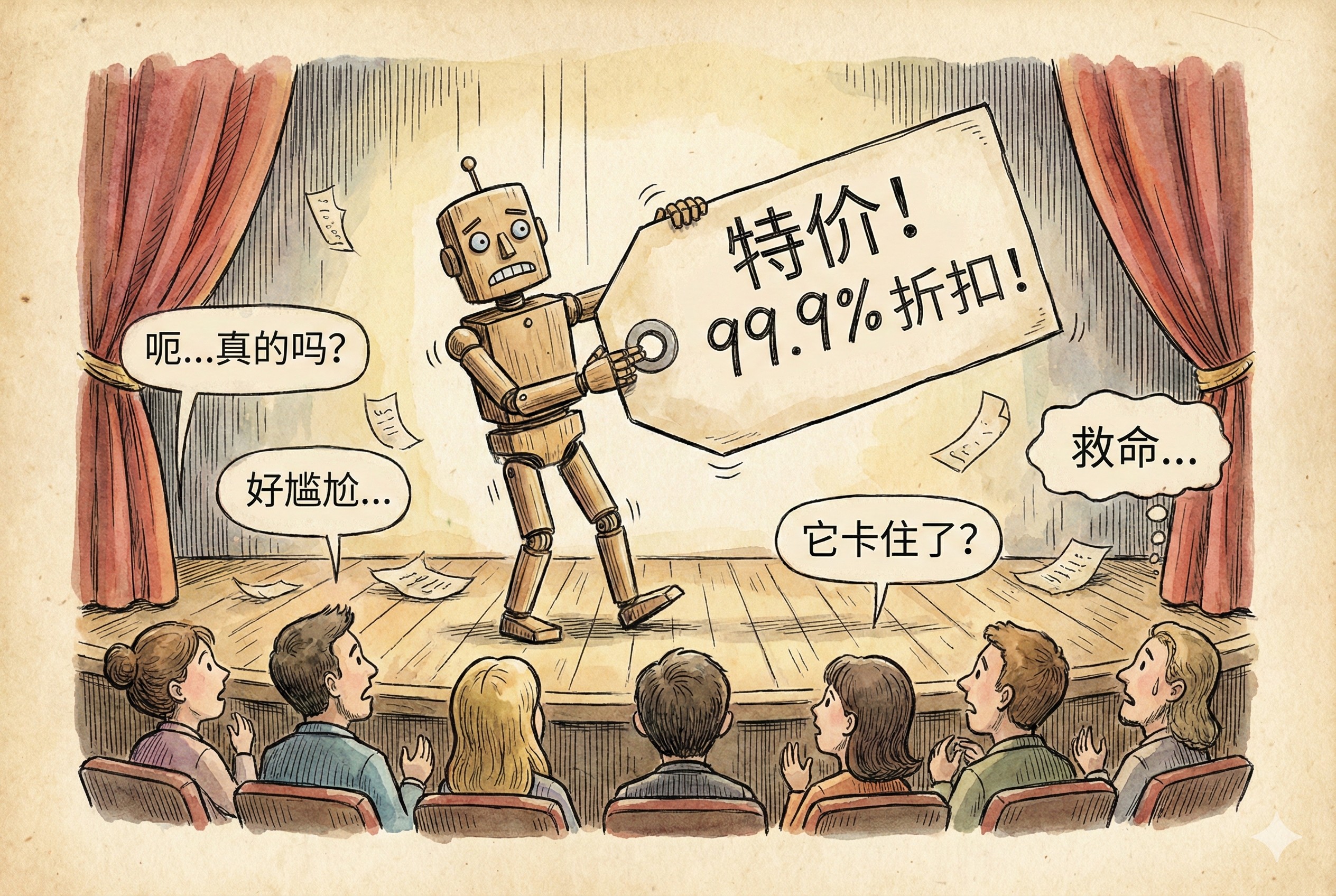

天下苦 A 社久矣。

这是前段时间 Anthropic 持续推出各种功能,但是一边又不断加强使用限制,读者在评论区最普遍的反应。

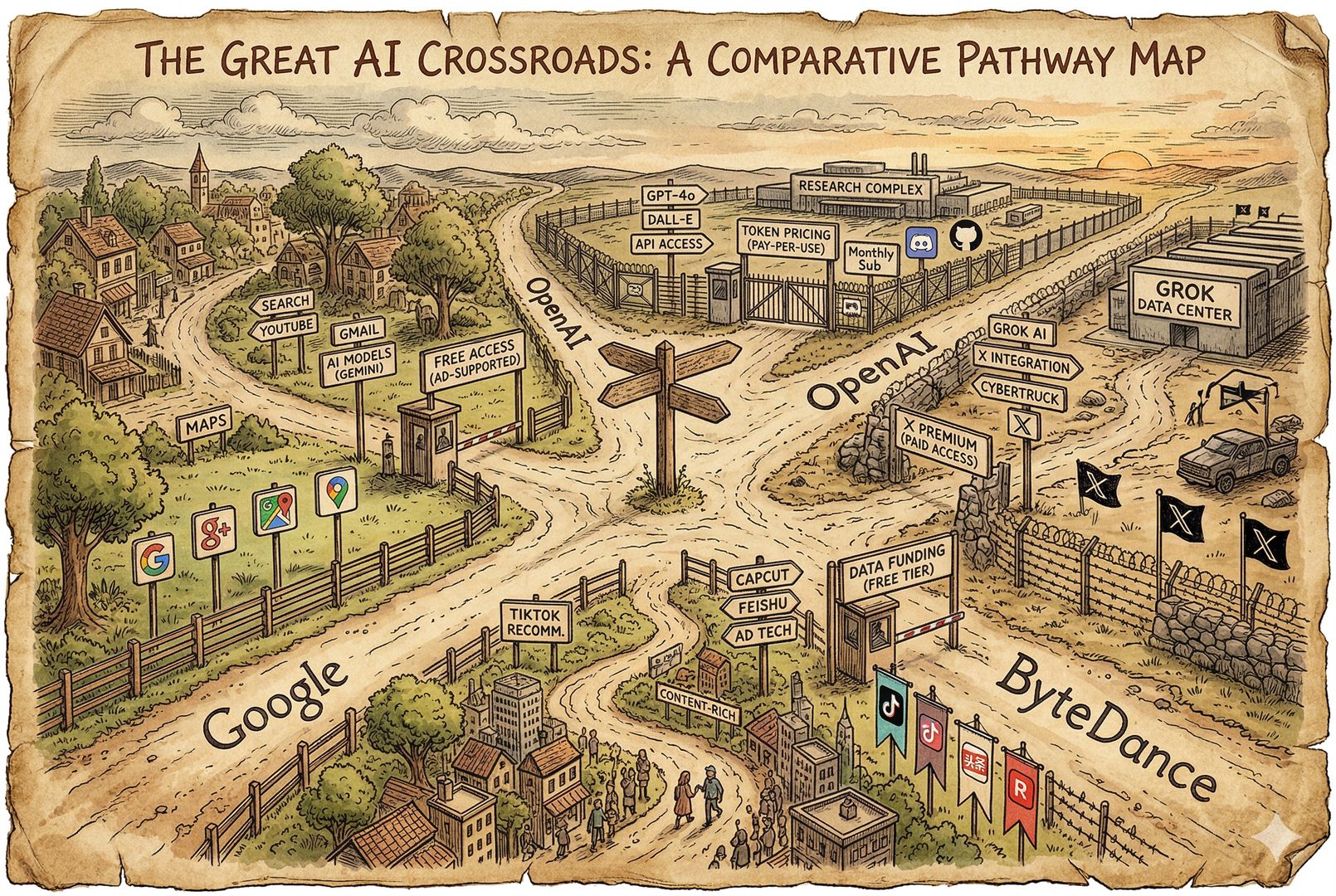

本身就是御三家(OpenAI、Google、Anthropic)里对使用限制最严格的一个,另一边又加码推出身份验证,实名制才能使用。今天凌晨,再把 Pro(20 美元/月)用户的 Claude Code 使用权给砍了。

Anthropic 的增长负责人出来回应,提到他们正在对约 2% 的新专业用户注册者进行小规模测试,现有 Pro 和 Max 用户不受影响;并表示目前的订阅计划无法应对用户大量的 Token 消耗,他们在研究新的付费方案。

▲来源:https://x.com/TheAmolAvasare/status/2046724659039932830

OpenAI 这边也立马回应了 Claude Code 踢掉 Pro 会员的争议,一位 Codex 负责人 Rohan Varma 直接怼脸和 Claude Code 竞争,连发文格式都和 Claude Code 一样。

▲来源:https://x.com/rohanvarma/status/2046769635350241292

Anthropic 为 2% 的用户测试更贵的计划,而 Codex 给 100% 用户测试,让免费和付费套餐都能使用 Codex。还特别调皮的加了一句「Claude Code 用户不受影响。」

▲Claude Code 用户 PAY(付钱),Codex 用户 PLAY(玩)

另一位 Codex 负责人 Tibo,也在 X 发文说 Codex 将继续提供免费版和 PLUS 版(20 美元/月),还提到 OpenAI 拥有足够的算力和厉害的模型来支持 Codex 的运作。

奥特曼也转发了这条推文,表示 「我们希望你们可以有大量的 AI。」

▲来源:https://x.com/sama/status/2046752492093165708

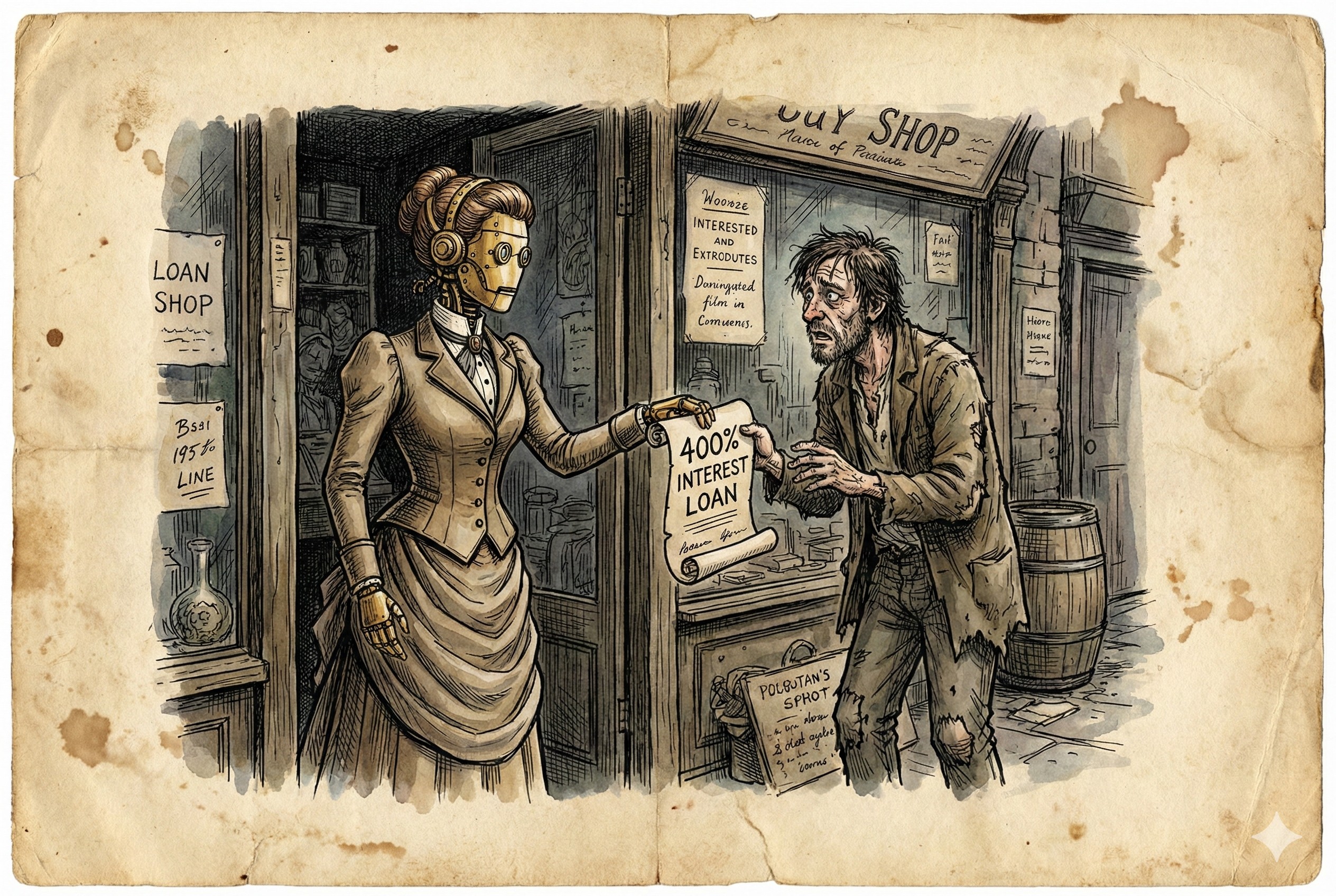

Codex 口碑在社交媒体上一直不算太差,尤其是前段时间 OpenAI「大撒币」,先是说为了让每个人都能体验到 Codex 推出的相关插件,给所有订阅计划都重置了使用限制。

4 月初,Codex 发现用户达到使用限制的频率增加,且未找到背后的原因,干脆就重置了所有用户的额度限制。几天前,为了庆祝 Codex 周年庆和新功能上线,又一次重置了所有套餐的用量限制。

今天,Codex 负责人和奥特曼再发推文,表示不到两周 Codex 增加了 100 万新用户,为了庆祝这件事,Codex 的速率限制又又又重置了。

▲来源:https://x.com/sama/status/2046604989527912590

早在上周 Anthropic 发布 Opus 4.7 的那天,Codex 就更新了一大堆重要功能,Computer Use、内置浏览器、持久记忆,以及 90 多项插件。

这些更新几乎是直接对标 Claude Cowork 的功能,把 Codex 从一个听着就像是给开发者用的工具,重新变成了一个适用于电脑所有场景的效率助手工具。

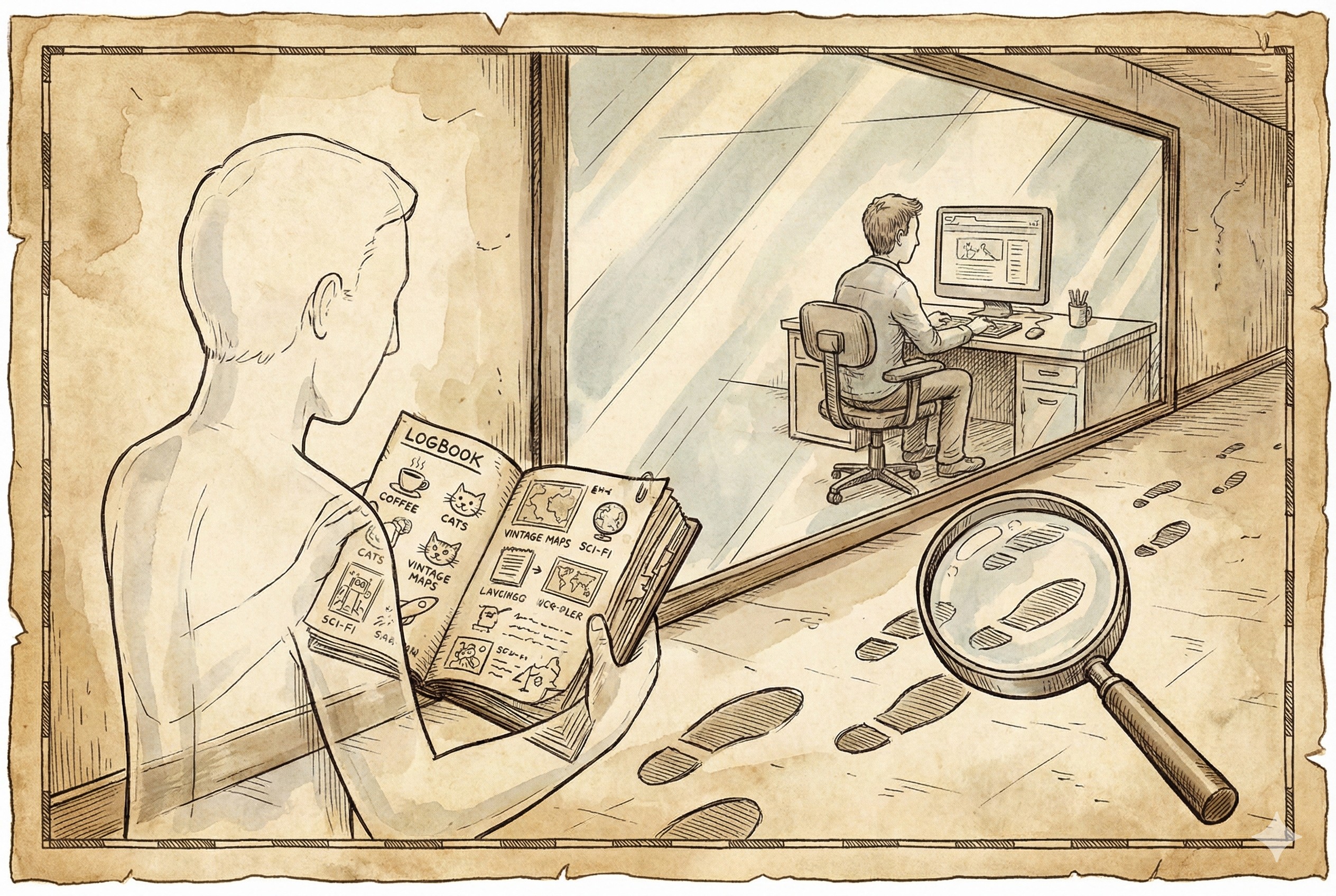

昨天,Codex 在此前推出记忆功能的基础上,又上线了一项名叫「Chronicle」的研究预览功能,让 AI 能读我们的屏幕,把我们最近做过的事整理成记忆。

Codex 不再只依赖聊天记录来理解上下文,结合它读取的近期屏幕内容,我们给它发送「这个」、「那个」,Codex 能知道我们到底指的是什么。

今天刚刚发布的 GPT Image 2 也已经集成到了 Codex 里。我们可以在 Codex 生成并迭代图像,在一套工作流里,从产品原型、前端设计,到视觉效果图和游戏开发等任务,使用 GPT Image 2 快速生成视觉元素。

如果你的 Claude 账号总是被封,用不了官方的 Claude Cowork、Claude Code 桌面版,又或者是那 2% 的新用户,开通了 20 美元/月的 Pro 会员也用不了 Claude Code,不妨来试试 OpenAI 出品的 Codex。

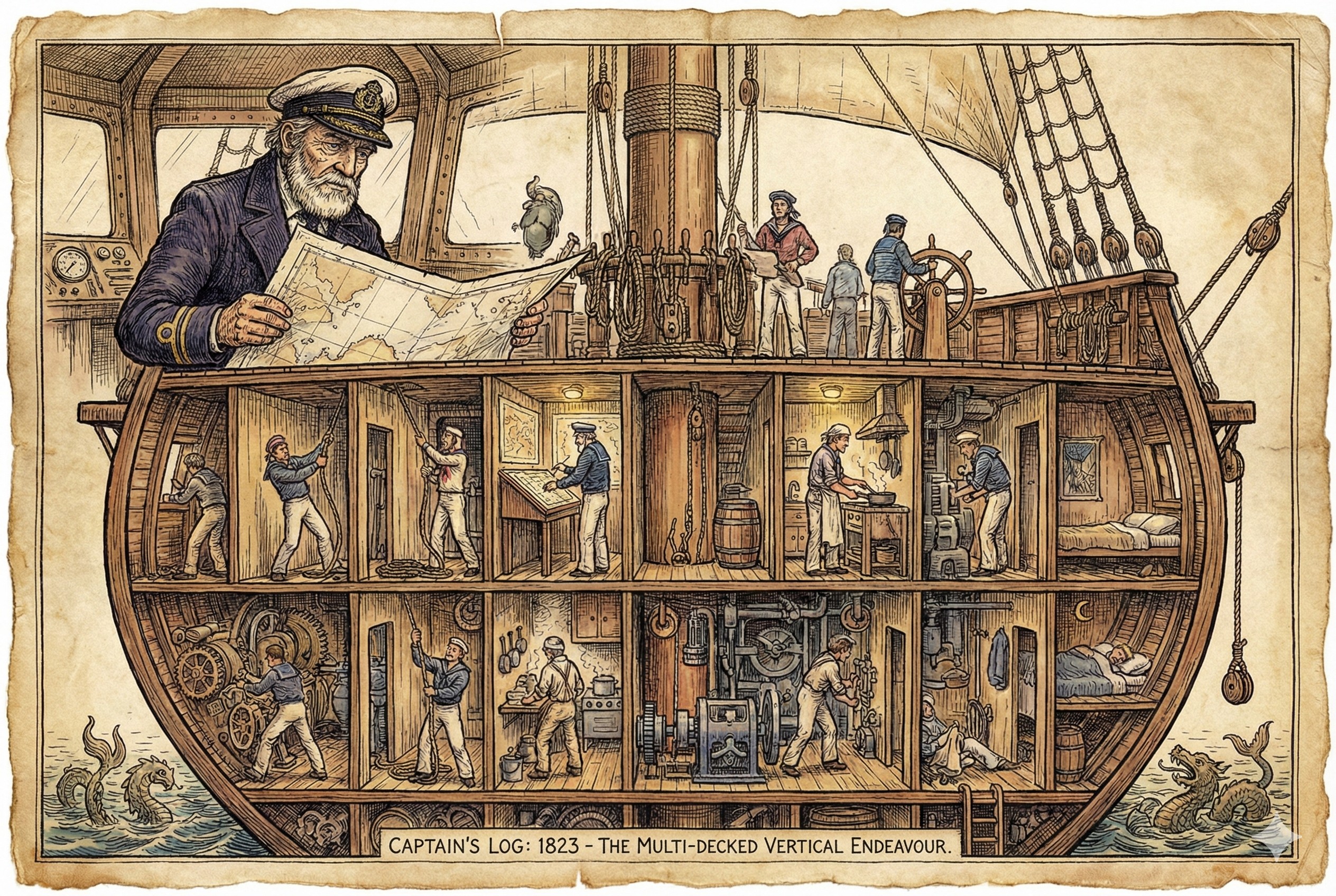

从代码工具到全能助手

Codex 最近这段时间的更新,最重要的莫过于上周发布的 Computer Use。这项能力并不算新鲜,之前是模型有 Computer Use 的能力,现在是需要工具也要有配套的支持,才能发挥模型能力。

它本质上就是 Agent 工具可以像人类操作电脑一样,通过视觉识别、点击和输入,自主操控电脑上的各类应用程序。

之前的 Codex 操作电脑上的软件,是通过一些命令来执行不同的应用任务,整体更像是我们喊「Siri,明天的天气怎么样」,做这些比较简单的任务。

有了 Computer Use 的能力之后,不仅支持一些调用 API 或者终端命令的工具,还能真的能帮我们完成一些电脑上的实际操作,尤其适合前端调试、应用测试、操作没有开放 API 的软件。

而且支持多个智能体并行在 Mac 上工作,不会影响我们正常使用其他应用。

需要注意的是,Computer Use 的能力只支持 macOS 15 以上的版本,我们的电脑(macOS 14.6.1)在测试 Codex 时,会自动弹出一个 SkyComputerUseClient 的问题报告。

另外,现在 Codex 支持内置浏览器,能更好地处理 Web 场景。我们在 Codex 里生成的网页,可以直接在网页上标注,给 Codex 更精准的操作指令,对一些前端、应用和游戏开发的快速迭代非常有用。

▲从 Coding、设计、生活方式、生产力到研究,Codex 现在有丰富的插件系统来处理各项任务

这次的更新还新增了 90 多个插件和更丰富的工具集成,让 Codex 能接入更多工具、获取更多上下文,并跨平台执行操作,提到的热门插件包括 Atlassian Rovo(JIRA)、Microsoft 套件、Neon by Databricks、Remotion、Render、Superpowers 等。

在 Codex 应用里,我们只需要输入斜线就能快速进入一些关于 Codex 的配置,输入 $,则可以选择不同的 Skills,包括我们安装在本地的各种 Skills。

同时,在自动化任务上,Codex 的 Automation 功能升级后,可以复用之前的对话线程,保留已有上下文。新的自动化还支持 Codex 自主规划后续工作、自动在未来某个时间继续执行任务,以及支持持续数天甚至数周的长期任务。

官方提到这项更新主要用于代码的提交合并、跟进日常工作生活的待办事项,以及跨越不同平台和工具的信息追踪等任务。

还有一些对于桌面应用交互的小更新,像是增加了多标签页的终端窗口,侧边栏可以直接打开文件,预览 PDF、表格、PPT 等文档。

新的摘要面板,也可以持续跟踪当前执行任务的计划和进度、参考信息来源,和输出结果等。这些应用上的增强,也让 Codex 在整体上更像是一个统一的工作台,而不再是单一的对话窗口。

用定时截屏的方式来维护 Agent 记忆

个性化的记忆功能向来就是 AI 的一大难题,虽然 AI 博古通今能记住所有的知识,但是对于每个用户的私人记忆处理,工作记忆等,AI 需要用不会占据大量的 Token,同时又能记清楚的方式来处理日复一日的对话。

尤其是现在到了 Agent 这类巨消耗 Token 的任务上,每个用户每天产生的上下文,如果 Agent 要全部记住,估计再来一百万 Token 上下文也难顶住。

上周 OpenAI 就已经为 Codex 带来了记忆功能,它可以记住我们的个人偏好、之前做过的修正,以及一些不容易获取但很重要的信息。

而为了获取更多的记忆,更快地处理我们的工作流。Codex 这次推出的 Chronicle 功能,说白了就是看我们的屏幕,记住我们的工作,再把这些记忆喂给 AI。

具体来说,在 Codex 设置>个性化里面,开了 Chronicle 功能之后,会自动执行这些操作:屏幕上下文捕获 → 本地临时截图 → 后台代理分析 → 临时 Codex 会话总结 → 生成本地 Markdown 记忆 → 后续会话中作为上下文使用。

Codex 获取了屏幕录制和无障碍权限之后,Chronicle 会在后台运行一个沙箱 Agent,这些 Agents 使用默认模型 GPT-5.4-mini,基于捕获到的屏幕图像,周期性地启动一个临时的 Codex 会话,把最近的屏幕上下文整理出记忆。

屏幕截图只会临时保存在本地,Codex 提到运行期间,超过 6 个小时截图会被自动删除。

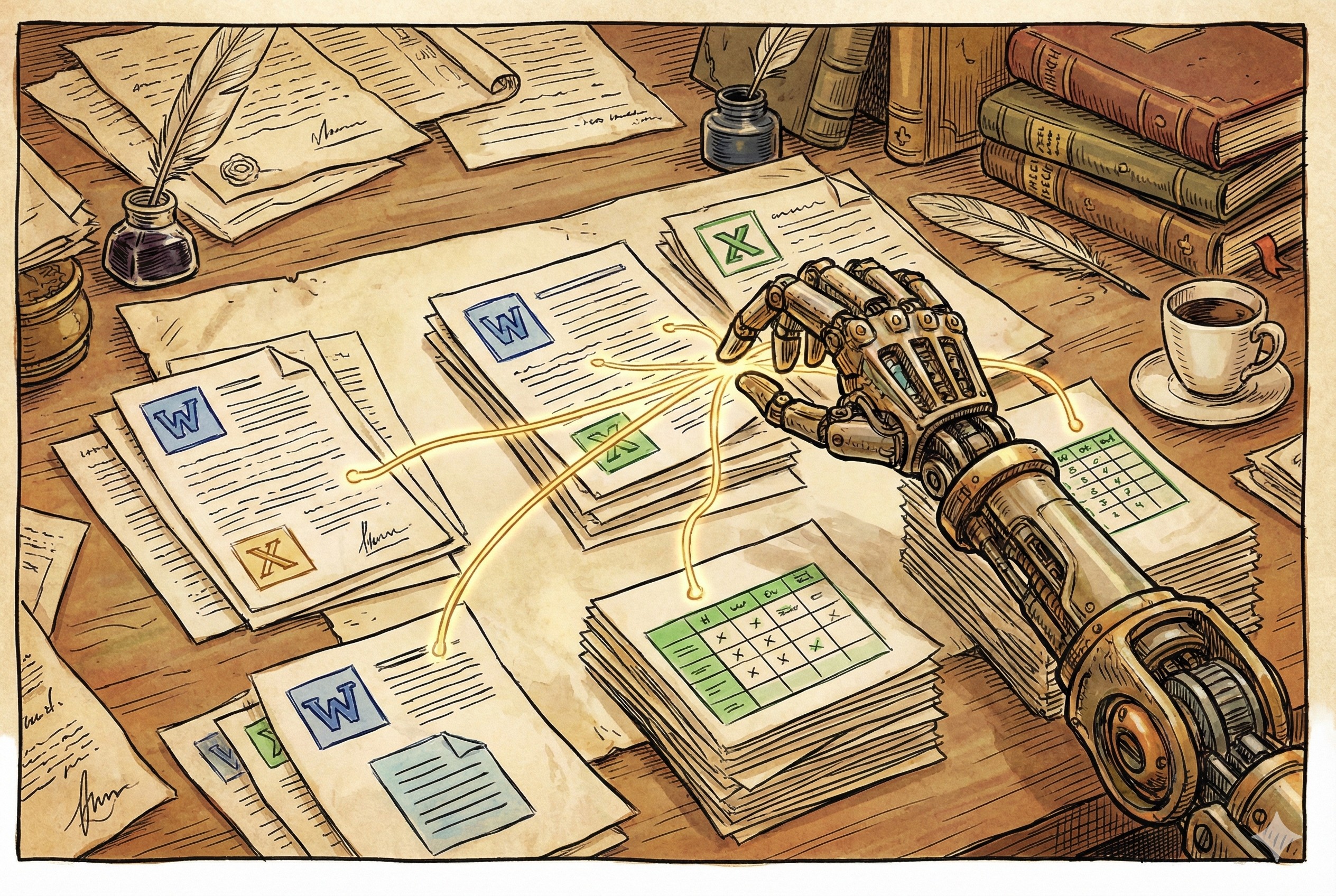

▲GPT Image 2 生成的信息图

以后我们和 Codex 对话,它会自动检索这些记忆文件,作为上下文来使用,减少我们重复描述背景的需要。

OpenAI 官方也给了多个案例,像是如果不开启 Chronicle,Codex 不知道我们说的「这里会失败」,是指的什么。

以及针对一些个人任务中出现的人名、项目名等,在通用知识外的内容,Codex 也会根据 Chronicle 获取的信息,自动补充上下文。

能够捕获屏幕图像,也意味着使用 Codex 处理任务的全流程,Chronicle 都能记住。包括我们的工作流,常用的工具。像下面的例子里,使用了 Chronicle 的 Codex 会知道这份宣传材料使用何种格式,以及何种工具,是 Google 文档还是 Markdown 文档。

不过这项功能也面临着一些争议,例如视觉识别的方法会消耗大量的 token,更严重的是这些截图可能包含我们屏幕上可见的敏感信息。

虽然 OpenAI 说所有保存的记忆都会存放在本地的 markdwon 文档里,用户可以随时查看,Codex 根据这些截屏获取到了哪些信息。但是他们也提醒用户,当 Chronicle 截屏到一些有风险的网站时,网站可能通过提示词注入的方式,在屏幕上隐藏一些恶意指令,让 Codex 执行。

Chronicle 这项功能目前仅向 ChatGPT Pro(200 美元/月)用户开放,支持 macOS 版本的 Codex 应用,作为研究预览版推出。待 Chronicle 正式上线之后,相信 Codex 会把它开放给更多用户使用。

手机遥控、电子宠物、「Hermes Agent」都有机会上线

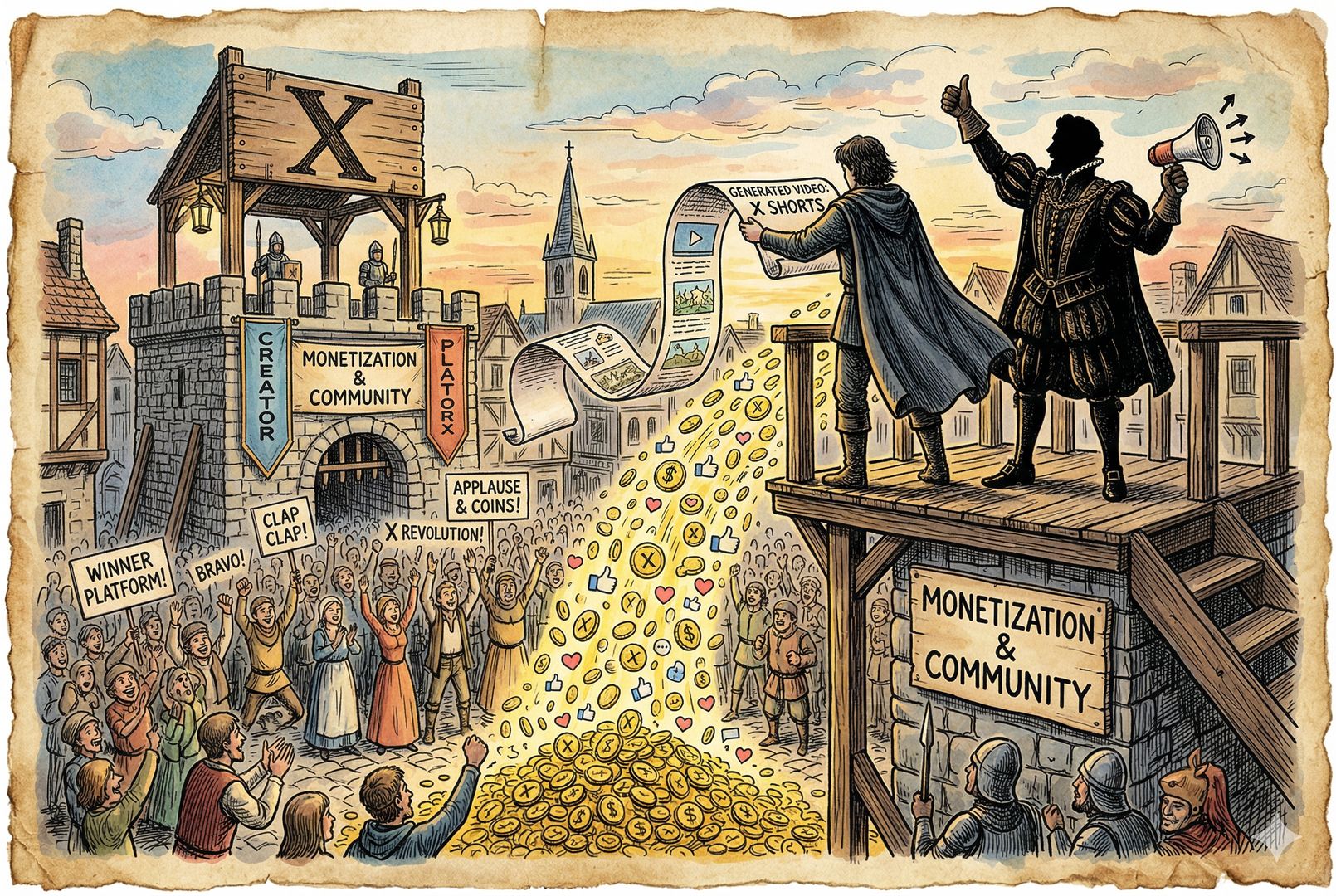

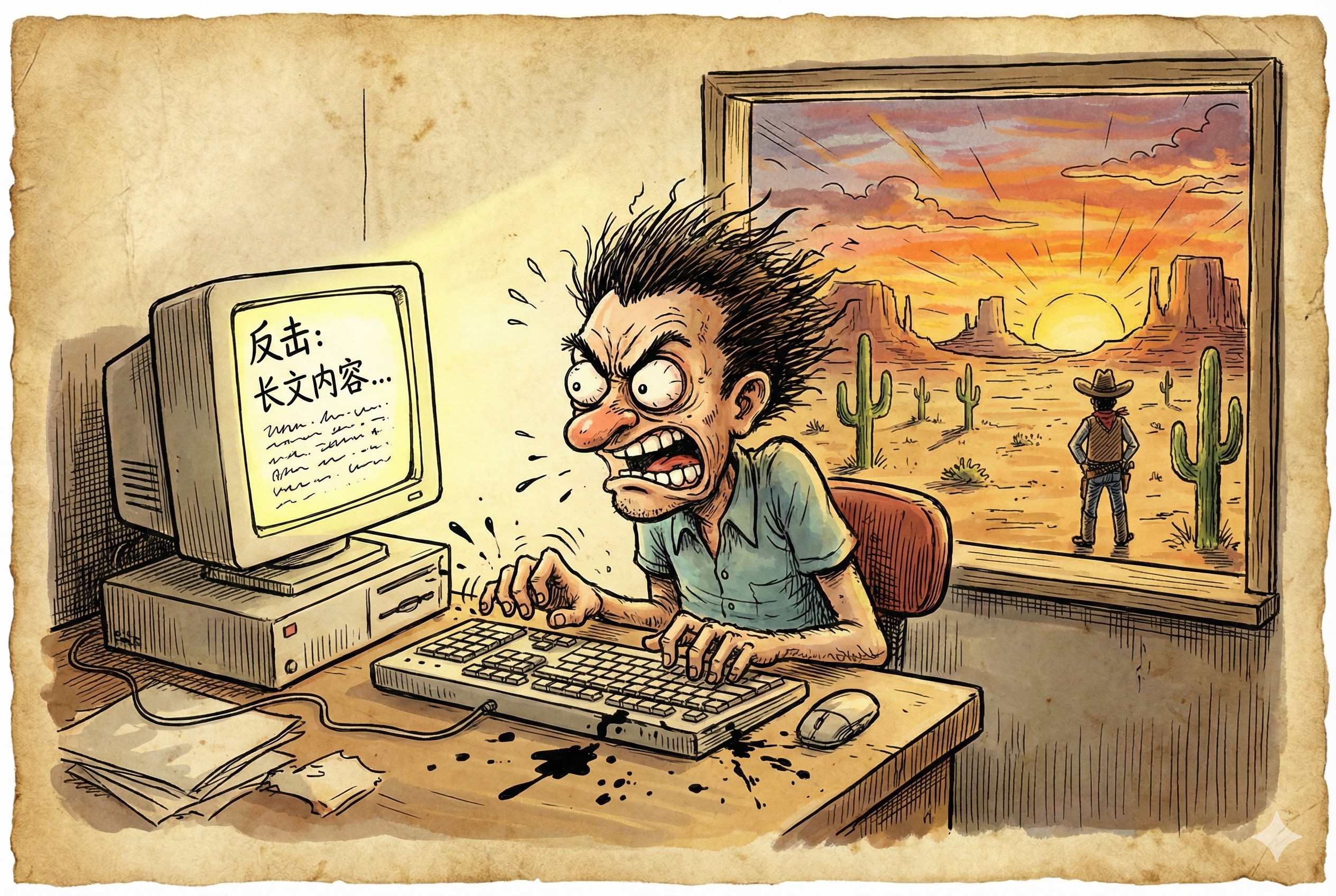

这段时间,Codex 被网友们称作是一款正在用力追赶 Claude 的产品。虽然一方面是在说 OpenAI 没有主见,随大流。但另一方面,能看到好的产品之间展开你追我赶的竞争,对我们用户来说未尝不是一件好事。

Codex 开发者在 X 上问大家对 Codex 有何意见,网友们非常积极的表示,要加上手机控制功能,还有人说 Codex 也应该从 ChatGPT App 里面进入。而这些都是 Claude 目前已经做到的功能。

也有网友在下面反馈 Codex 存在的各种 Bug,像是内存泄露、会话只能存档不能删除等问题。

最新的 Codex 更新爆料里还提到,Codex 也打算做一个小小电子宠物,放在 Codex 桌面上,来提示用户目前会话的各种状态。

这个电子宠物共有 8 种预设形象,用户还可以创建使用自己的虚拟形象。

▲来源:https://x.com/testingcatalog/status/2046366630528143827

另一个爆料则提到 OpenAI 正在为 ChatGPT 开发智能体(代号 Hermes),其中包括智能体构建器、模板、日程安排、在 Slack 中使用智能体的选项、添加应用程序、技能、文件、内存、指令等功能。

▲来源:https://x.com/btibor91/status/2046545878538961304/

眼下的 Codex 是一个活跃开发的产品,OpenAI 必然不会把本地 Agent 产品这一块的市场拱手让给 Claude。

别说 OpenAI 这位 AI 界的老大哥,前几天,Gemini 也不声不响地发布了桌面版应用,但是被一众网友评价「拉爆了」。

只能鼓励一下 OpenAI 和 Gemini,赶快结束 Claude 在本地 Agent 助手和代码这块的领先地位。

天下苦 A 社久矣。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。