本文永久链接 – https://tonybai.com/2025/05/31/six-smells-in-go

大家好,我是Tony Bai。

在日常的代码审查 (Code Review) 和线上问题复盘中,我经常会遇到一些看似不起眼,却可能埋下巨大隐患的 Go 代码问题。这些“编码坏味道”轻则导致逻辑混乱、性能下降,重则引发数据不一致、系统崩溃,甚至让团队成员在深夜被告警声惊醒,苦不堪言。

今天,我就结合自己团队中的一些“血淋淋”的经验,和大家聊聊那些曾让我(或许也曾让你)头痛不已的 Go 编码坏味道。希望通过这次复盘,我们都能从中吸取教训,写出更健壮、更优雅、更经得起考验的 Go 代码。

坏味道一:异步时序的“迷魂阵”——“我明明更新了,它怎么还是旧的?”

在高并发场景下,为了提升性能,我们经常会使用 goroutine 进行异步操作。但如果对并发操作的原子性和顺序性缺乏正确理解,就很容易掉进异步时序的陷阱。

典型场景:先异步通知,后更新状态

想象一下,我们有一个订单处理系统,当用户支付成功后,需要先异步发送一个通知给营销系统(比如发优惠券),然后再更新订单数据库的状态为“已支付”。

package main

import (

"fmt"

"sync"

"time"

)

type Order struct {

ID string

Status string // "pending", "paid", "notified"

}

func updateOrderStatusInDB(order *Order, status string) {

fmt.Printf("数据库:订单 %s 状态更新为 %s\n", order.ID, status)

order.Status = status // 模拟数据库更新

}

func asyncSendNotification(order *Order) {

fmt.Printf("营销系统:收到订单 %s 通知,当前状态:%s。准备发送优惠券...\n", order.ID, order.Status)

// 模拟耗时操作

time.Sleep(50 * time.Millisecond)

fmt.Printf("营销系统:订单 %s 优惠券已发送 (基于状态:%s)\n", order.ID, order.Status)

}

func main() {

order := &Order{ID: "123", Status: "pending"}

var wg sync.WaitGroup

fmt.Printf("主流程:订单 %s 支付成功,准备处理...\n", order.ID)

// 坏味道:先启动异步通知,再更新数据库状态

wg.Add(1)

go func(o *Order) { // 注意这里传递了指针

defer wg.Done()

asyncSendNotification(o)

}(order) // goroutine 捕获的是 order 指针

// 模拟主流程的其他操作,或者数据库更新前的延时

time.Sleep(500 * time.Millisecond)

updateOrderStatusInDB(order, "paid") // 更新数据库状态

wg.Wait()

fmt.Printf("主流程:订单 %s 处理完毕,最终状态:%s\n", order.ID, order.Status)

}

该示例的可能输出:

主流程:订单 123 支付成功,准备处理...

营销系统:收到订单 123 通知,当前状态:pending。准备发送优惠券...

营销系统:订单 123 优惠券已发送 (基于状态:pending)

数据库:订单 123 状态更新为 paid

主流程:订单 123 处理完毕,最终状态:paid

我们看到营销系统拿到的优惠券居然是基于“pending”状态。

问题分析:

在上面的代码中,asyncSendNotification goroutine 和 updateOrderStatusInDB 是并发执行的。由于 asyncSendNotification 启动在先,并且捕获的是 order 指针,它很可能在 updateOrderStatusInDB 将订单状态更新为 “paid” 之前 就读取了 order.Status。这就导致营销系统基于一个过时的状态(”pending”)发送了通知或优惠券,引发业务逻辑错误。

避坑指南:

- 确保关键操作的同步性或顺序性: 对于有严格先后顺序要求的操作,不要轻易异步化。如果必须异步,确保依赖的操作完成后再执行。

- 使用同步原语: 利用 sync.WaitGroup、channel 等确保操作的正确顺序。例如,可以先更新数据库,再启动异步通知。

- 传递值而非指针(如果适用): 如果异步操作仅需快照数据,考虑传递值的副本,而不是指针。但在很多场景下,我们确实需要操作同一个对象。

- 在异步回调中重新获取最新状态: 如果异步回调依赖最新状态,应在回调函数内部重新从可靠数据源(如数据库)获取,而不是依赖启动时捕获的状态。

修正示例思路:

// ... (Order, updateOrderStatusInDB, asyncSendNotification 定义不变) ...

func main() {

order := &Order{ID: "123", Status: "pending"}

var wg sync.WaitGroup

fmt.Printf("主流程:订单 %s 支付成功,准备处理...\n", order.ID)

updateOrderStatusInDB(order, "paid") // 先更新数据库状态

// 再启动异步通知

wg.Add(1)

go func(o Order) { // 传递结构体副本,或者在异步函数内部重新获取

defer wg.Done()

// 实际场景中,如果 asyncSendNotification 依赖的是更新后的状态,

// 它应该有能力从某个地方(比如参数,或者内部重新查询)获取到 "paid" 这个状态。

// 这里简化为直接使用传入时的状态,但强调其应为 "paid"。

// 或者,更好的方式是 asyncSendNotification 接受一个 status 参数。

clonedOrderForNotification := o // 假设我们传递的是更新后的状态的副本

asyncSendNotification(&clonedOrderForNotification)

}(*order) // 传递 order 的副本,此时 order.Status 已经是 "paid"

wg.Wait()

fmt.Printf("主流程:订单 %s 处理完毕,最终状态:%s\n", order.ID, order.Status)

}

坏味道二:指针与闭包的“爱恨情仇”——“我以为它没变,结果它却跑了!”

闭包是 Go 语言中一个强大的特性,它能够捕获其词法作用域内的变量。然而,当闭包捕获的是指针,并且这个指针指向的数据在 goroutine 启动后可能被外部修改,或者指针本身被重新赋值时,就可能导致并发问题和难以预料的行为。虽然 Go 1.22+ 通过实验性的 GOEXPERIMENT=loopvar 改变了 for 循环变量的捕获语义,解决了经典的循环变量闭包陷阱,但指针与闭包结合时对共享可变状态的考量依然重要。

典型场景:闭包捕获指针,外部修改指针或其指向内容

我们来看一个不涉及循环变量,但同样能体现指针与闭包问题的场景:

package main

import (

"fmt"

"sync"

"time"

)

type Config struct {

Version string

Timeout time.Duration

}

func watchConfig(cfg *Config, wg *sync.WaitGroup) {

defer wg.Done()

// 这个 goroutine 期望在其生命周期内使用 cfg 指向的配置

// 但如果外部在它执行期间修改了 cfg 指向的内容,或者 cfg 本身被重新赋值,

// 那么这个 goroutine 看到的内容就可能不是启动时的那个了。

fmt.Printf("Watcher: 开始监控配置 (Version: %s, Timeout: %v)\n", cfg.Version, cfg.Timeout)

time.Sleep(100 * time.Millisecond) // 模拟监控工作

fmt.Printf("Watcher: 监控结束,使用的配置 (Version: %s, Timeout: %v)\n", cfg.Version, cfg.Timeout)

}

func main() {

currentConfig := &Config{Version: "v1.0", Timeout: 5 * time.Second}

var wg sync.WaitGroup

fmt.Printf("主流程:初始配置 (Version: %s, Timeout: %v)\n", currentConfig.Version, currentConfig.Timeout)

// 启动一个 watcher goroutine,它捕获了 currentConfig 指针

wg.Add(1)

go watchConfig(currentConfig, &wg) // currentConfig 指针被传递

// 主流程在 watcher goroutine 执行期间,修改了 currentConfig 指向的内容

time.Sleep(10 * time.Millisecond) // 确保 watcher goroutine 已经启动并打印了初始配置

fmt.Println("主流程:检测到配置更新,准备在线修改...")

currentConfig.Version = "v2.0" // 直接修改了指针指向的内存内容

currentConfig.Timeout = 10 * time.Second

fmt.Printf("主流程:配置已修改为 (Version: %s, Timeout: %v)\n", currentConfig.Version, currentConfig.Timeout)

// 或者更极端的情况,主流程让 currentConfig 指向了一个全新的 Config 对象

// time.Sleep(10 * time.Millisecond)

// fmt.Println("主流程:检测到配置需要完全替换...")

// currentConfig = &Config{Version: "v3.0", Timeout: 15 * time.Second} // currentConfig 指向了新的内存地址

// fmt.Printf("主流程:配置已替换为 (Version: %s, Timeout: %v)\n", currentConfig.Version, currentConfig.Timeout)

// 注意:如果 currentConfig 被重新赋值指向新对象,原 watchConfig goroutine 仍然持有旧对象的指针。

// 但如果原意是让 watchConfig 感知到“最新的配置”,那么这种方式是错误的。

wg.Wait()

fmt.Println("主流程:所有处理完毕。")

fmt.Println("\n--- 更安全的做法:传递副本或不可变快照 ---")

// 更安全的做法:如果 goroutine 需要的是启动时刻的配置快照

stableConfig := &Config{Version: "v1.0-stable", Timeout: 5 * time.Second}

configSnapshot := *stableConfig // 创建一个副本

wg.Add(1)

go func(cfgSnapshot Config, wg *sync.WaitGroup) { // 传递的是 Config 值的副本

defer wg.Done()

fmt.Printf("SafeWatcher: 开始监控配置 (Version: %s, Timeout: %v)\n", cfgSnapshot.Version, cfgSnapshot.Timeout)

time.Sleep(100 * time.Millisecond)

// 即使外部修改了 stableConfig,cfgSnapshot 依然是启动时的值

fmt.Printf("SafeWatcher: 监控结束,使用的配置 (Version: %s, Timeout: %v)\n", cfgSnapshot.Version, cfgSnapshot.Timeout)

}(configSnapshot, &wg)

time.Sleep(10 * time.Millisecond)

stableConfig.Version = "v2.0-stable" // 修改原始配置

stableConfig.Timeout = 10 * time.Second

fmt.Printf("主流程:stableConfig 已修改为 (Version: %s, Timeout: %v)\n", stableConfig.Version, stableConfig.Timeout)

wg.Wait()

fmt.Println("主流程:所有安全处理完毕。")

}

问题分析:

在第一个示例中,watchConfig goroutine 通过闭包(函数参数也是一种闭包形式)捕获了 currentConfig 指针。这意味着 watchConfig 内部对 cfg 的访问,实际上是访问 main goroutine 中 currentConfig 指针所指向的那块内存。

- 当外部修改指针指向的内容时: 如代码中 currentConfig.Version = “v2.0″,watchConfig goroutine 在后续访问 cfg.Version 时,会看到这个被修改后的新值,这可能不是它启动时期望的行为。

- 当外部修改指针本身时 (注释掉的极端情况): 如果 currentConfig = &Config{Version: “v3.0″, …},那么 watchConfig 捕获的 cfg 仍然指向原始的 Config 对象(即 “v1.0″ 那个)。如果此时的业务逻辑期望 watchConfig 使用“最新的配置对象”,那么这种捕获指针的方式就会导致错误。

这些问题的根源在于对共享可变状态的并发访问缺乏控制,以及对指针生命周期和闭包捕获机制的理解不够深入。

避坑指南:

-

明确 goroutine 需要的数据快照还是共享状态:

- 如果 goroutine 只需要启动时刻的数据快照,并且不希望受外部修改影响,那么应该传递值的副本给 goroutine(或者在闭包内部创建副本)。如第二个示例中的 configSnapshot。

- 如果 goroutine 需要与外部共享并感知状态变化,那么必须使用同步机制(如 mutex、channel、atomic 操作)来保护对共享状态的访问,确保数据一致性和避免竞态条件。

-

谨慎捕获指针,特别是那些可能在 goroutine 执行期间被修改的指针:

- 如果捕获了指针,要清楚地知道这个指针的生命周期,以及它指向的数据是否会被其他 goroutine 修改。

- 如果指针指向的数据是可变的,并且多个 goroutine 会并发读写,必须加锁保护。

-

考虑数据的不可变性: 如果可能,尽量使用不可变的数据结构。将不可变的数据传递给 goroutine 是最安全的并发方式之一。

-

对于经典的 for 循环启动 goroutine 捕获循环变量的问题:

- Go 1.22+ (启用 GOEXPERIMENT=loopvar) 或未来版本: 语言层面已经解决了每次迭代共享同一个循环变量的问题,每次迭代会创建新的变量实例。此时,直接在闭包中捕获循环变量是安全的。

- Go 1.21 及更早版本 (或未启用 loopvar 实验特性): 仍然需要通过函数参数传递的方式来确保每个 goroutine 捕获到正确的循环变量值。例如:

for i, v := range values {

valCopy := v // 如果 v 是复杂类型,可能需要更深的拷贝

indexCopy := i

go func() {

// 使用 valCopy 和 indexCopy

}()

}

// 或者更推荐的方式:

for i, v := range values {

go func(idx int, valType ValueType) { // ValueType 是 v 的类型

// 使用 idx 和 valType

}(i, v)

}

虽然 Go 语言在 for 循环变量捕获方面做出了改进,但指针与闭包结合时对共享状态和生命周期的审慎思考,仍然是编写健壮并发程序的关键。

坏味道三:错误处理的哲学——“是Bug就让它崩!”真的好吗?

Go 语言通过返回 error 值来处理可预期的错误,而 panic 则用于表示真正意外的、程序无法继续正常运行的严重错误,通常由运行时错误(如数组越界、空指针解引用)或显式调用 panic() 引发。当 panic 发生且未被 recover 时,程序会崩溃并打印堆栈信息。

一种常见的观点是:“如果是 Bug,就应该让它尽快崩溃 (Fail Fast)”,以便问题能被及时发现和修复。这种观点在很多情况下是合理的。然而,在某些 mission-critical(关键任务)系统中,例如金融交易系统、空中交通管制系统、重要的基础设施服务等,一次意外的宕机重启可能导致不可估量的损失或严重后果。在这些场景下,即使因为一个未捕获的 Bug 导致了 panic,我们也可能期望系统能有一定的“韧性”,而不是轻易“放弃治疗”。

典型场景:一个关键服务在处理请求时因 Bug 发生 Panic

package main

import (

"fmt"

"net/http"

"runtime/debug"

"time"

)

// 模拟一个关键数据处理器

type CriticalDataProcessor struct {

// 假设有一些内部状态

activeConnections int

lastProcessedID string

}

// 处理数据的方法,这里故意引入一个可能导致 panic 的 bug

func (p *CriticalDataProcessor) Process(dataID string, payload map[string]interface{}) error {

fmt.Printf("Processor: 开始处理数据 %s\n", dataID)

p.activeConnections++

defer func() { p.activeConnections-- }() // 确保连接数正确管理

// 模拟一些复杂逻辑

time.Sleep(50 * time.Millisecond)

// !!!潜在的 Bug !!!

// 假设 payload 中 "user" 字段应该是一个结构体指针,但有时可能是 nil

// 或者,某个深层嵌套的访问可能导致空指针解引用

// 为了演示,我们简单模拟一个 nil map 访问导致的 panic

var userDetails map[string]string

// userDetails = payload["user"].(map[string]string) // 这本身也可能 panic 如果类型断言失败

// 为了稳定复现 panic,我们直接让 userDetails 为 nil

if dataID == "buggy-data-001" { // 特定条件下触发 bug

fmt.Printf("Processor: 触发 Bug,尝试访问 nil map '%s'\n", userDetails["name"]) // 这里会 panic

}

p.lastProcessedID = dataID

fmt.Printf("Processor: 数据 %s 处理成功\n", dataID)

return nil

}

// HTTP Handler - 版本1: 不做任何 recover

func handleRequestVersion1(processor *CriticalDataProcessor) http.HandlerFunc {

return func(w http.ResponseWriter, r *http.Request) {

dataID := r.URL.Query().Get("id")

if dataID == "" {

http.Error(w, "缺少 id 参数", http.StatusBadRequest)

return

}

// 模拟从请求中获取 payload

payload := make(map[string]interface{})

// if dataID == "buggy-data-001" {

// // payload["user"] 可能是 nil 或错误类型,导致 Process 方法 panic

// }

err := processor.Process(dataID, payload) // 如果 Process 发生 panic,整个 HTTP server goroutine 会崩溃

if err != nil {

http.Error(w, fmt.Sprintf("处理失败: %v", err), http.StatusInternalServerError)

return

}

fmt.Fprintf(w, "请求 %s 处理成功\n", dataID)

}

}

// HTTP Handler - 版本2: 在每个请求处理的 goroutine 顶层 recover

func handleRequestVersion2(processor *CriticalDataProcessor) http.HandlerFunc {

return func(w http.ResponseWriter, r *http.Request) {

defer func() {

if err := recover(); err != nil {

fmt.Fprintf(os.Stderr, "!!!!!!!!!!!!!! PANIC 捕获 !!!!!!!!!!!!!!\n")

fmt.Fprintf(os.Stderr, "错误: %v\n", err)

fmt.Fprintf(os.Stderr, "堆栈信息:\n%s\n", debug.Stack())

fmt.Fprintf(os.Stderr, "!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!!\n")

// 向客户端返回一个通用的服务器错误

http.Error(w, "服务器内部错误,请稍后重试", http.StatusInternalServerError)

// 可以在这里记录更详细的错误到日志系统、发送告警等

// 例如:log.Errorf("Panic recovered: %v, Stack: %s", err, debug.Stack())

// metrics.Increment("panic_recovered_total")

// 重要:根据系统的 mission-critical 程度和业务逻辑,

// 这里可能还需要做一些清理工作,或者尝试让系统保持在一种“安全降级”的状态。

// 但要注意,recover 后的状态可能是不确定的,需要非常谨慎。

}

}()

dataID := r.URL.Query().Get("id")

if dataID == "" {

http.Error(w, "缺少 id 参数", http.StatusBadRequest)

return

}

payload := make(map[string]interface{})

err := processor.Process(dataID, payload)

if err != nil {

// 正常错误处理

http.Error(w, fmt.Sprintf("处理失败: %v", err), http.StatusInternalServerError)

return

}

fmt.Fprintf(w, "请求 %s 处理成功\n", dataID)

}

}

func main() {

processor := &CriticalDataProcessor{}

// mux1 使用 Version1 handler (不 recover)

// mux2 使用 Version2 handler (recover)

// 启动 HTTP 服务器 (这里为了演示,只启动一个,实际中会选择一个)

// 你可以注释掉一个,运行另一个来观察效果

// http.HandleFunc("/v1/process", handleRequestVersion1(processor))

// fmt.Println("V1 Server (不 recover) 启动在 :8080/v1/process")

// go http.ListenAndServe(":8080", nil)

http.DefaultServeMux.HandleFunc("/v2/process", handleRequestVersion2(processor))

fmt.Println("V2 Server (recover) 启动在 :8081/v2/process")

go http.ListenAndServe(":8081", nil)

fmt.Println("\n请在浏览器或使用 curl 测试:")

fmt.Println(" 正常请求: curl 'http://localhost:8081/v2/process?id=normal-data-002'")

fmt.Println(" 触发Bug的请求: curl 'http://localhost:8081/v2/process?id=buggy-data-001'")

fmt.Println(" (如果启动V1服务,触发Bug的请求会导致服务崩溃)")

select {} // 阻塞 main goroutine,保持服务器运行

}

问题分析:

- 不 Recover (handleRequestVersion1): 当 processor.Process 方法因为 Bug(例如访问 nil map userDetails["name"])而发生 panic 时,如果这个 panic 没有在当前 goroutine 的调用栈中被 recover,它会一直向上传播。对于由 net/http 包为每个请求创建的 goroutine,如果 panic 未被处理,将导致该 goroutine 崩溃。在某些情况下(取决于 Go 版本和 HTTP server 实现的细节),这可能导致整个 HTTP 服务器进程终止,或者至少是该连接的处理异常中断,影响服务可用性。

- Recover (handleRequestVersion2): 通过在每个请求处理的 goroutine 顶层使用 defer func() { recover() }(),我们可以捕获这个由 Bug 引发的 panic。捕获后,我们可以:

- 记录详细的错误信息和堆栈跟踪,便于事后分析和修复 Bug。

- 向当前请求的客户端返回一个通用的错误响应(例如 HTTP 500),而不是让连接直接断开或无响应。

- 关键在于: 阻止了单个请求处理中的 Bug 导致的 panic 扩散到导致整个服务不可用的地步。服务本身仍然可以继续处理其他正常的请求。

“是Bug就让它崩!”的观点在很多开发和测试环境中是值得提倡的,因为它能让我们更快地发现和定位问题。然而,在线上,特别是对于 mission-critical 系统:

- 可用性是第一要务: 一次意外的全面宕机,可能比单个请求处理失败带来的损失大得多。

- 数据一致性风险: 如果 panic 发生在关键数据操作的中间状态,直接崩溃可能导致数据不一致或损坏。recover 之后虽然也需要谨慎处理状态,但至少给了我们一个尝试回滚或记录问题的机会。

- 用户体验: 对用户而言,遇到一个“服务器内部错误”然后重试,通常比整个服务长时间无法访问要好一些。

避坑与决策指南:

- 在关键服务的请求处理入口或 goroutine 顶层设置 recover 机制: 这是构建健壮服务的推荐做法。

- recover 应该与 defer 配合使用。

- 在 recover 逻辑中,务必记录详细的错误信息、堆栈跟踪,并考虑集成到告警系统。

- recover 之后做什么?——视情况而定,但要极其谨慎:

- 对于单个请求处理 goroutine: 通常的做法是记录错误,向当前客户端返回错误响应,然后让该 goroutine 正常结束。避免让这个 panic 影响其他请求。

- 对于核心的、管理全局状态的 goroutine: 如果发生 panic,表明系统可能处于一种非常不稳定的状态。recover 后,可能需要执行一些清理操作,尝试将系统恢复到一个已知的安全状态,或者进行优雅关闭并重启。绝对不应该假装什么都没发生,继续使用可能已损坏的状态。

- “苟活”的度: “苟活”不代表对 Bug 视而不见。recover 的目的是保障服务的整体可用性,同时为我们争取定位和修复 Bug 的时间。捕获到的 panic 必须被视为高优先级事件进行处理。

- 库代码应极度克制 panic: 库不应该替应用程序做“是否崩溃”的决策。

- 测试,测试,再测试: 通过充分的单元测试、集成测试和压力测试,尽可能在上线前发现和消除潜在的 Bug,减少线上发生 panic 的概率。可以使用 Go 的 race detector 来检测并发代码中的竞态条件。

- 不要滥用 panic/recover 作为正常的错误处理机制: panic/recover 主要用于处理不可预料的、灾难性的运行时错误或程序缺陷,而不是替代 error 返回值来处理业务逻辑中的预期错误。

“是Bug就让它崩!”在开发阶段有助于快速发现问题,但在生产环境,特别是 mission-critical 系统中,“有控制地恢复,详细记录,并保障整体服务可用性” 往往是更明智的选择。这并不意味着容忍 Bug,而是采用一种更成熟、更负责任的方式来应对突发状况,确保系统在面对未知错误时仍能表现出足够的韧性。

坏味道四:http.Client 的“一次性”误区——“每次都新建,省心又省事?”

Go 标准库的 net/http 包提供了强大的 HTTP客户端功能。但有些开发者(尤其是初学者)在使用 http.Client 时,会为每一个 HTTP 请求都创建一个新的 http.Client 实例。

典型场景:函数内部频繁创建 http.Client

package main

import (

"fmt"

"io/ioutil"

"net/http"

"time"

)

// 坏味道:每次调用都创建一个新的 http.Client

func fetchDataFromAPI(url string) (string, error) {

client := &http.Client{ // 每次都新建 Client

Timeout: 10 * time.Second,

}

resp, err := client.Get(url)

if err != nil {

return "", err

}

defer resp.Body.Close()

body, err := ioutil.ReadAll(resp.Body)

if err != nil {

return "", err

}

return string(body), nil

}

// 正确的方式:复用 http.Client

var sharedClient = &http.Client{ // 全局或适当范围复用的 Client

Timeout: 10 * time.Second,

// 可以配置 Transport 以控制连接池等

// Transport: &http.Transport{

// MaxIdleConns: 100,

// MaxIdleConnsPerHost: 10,

// IdleConnTimeout: 90 * time.Second,

// },

}

func fetchDataFromAPIReusable(url string) (string, error) {

resp, err := sharedClient.Get(url) // 复用 Client

if err != nil {

return "", err

}

defer resp.Body.Close()

body, err := ioutil.ReadAll(resp.Body)

if err != nil {

return "", err

}

return string(body), nil

}

func main() {

// 模拟多次调用

// 如果使用 fetchDataFromAPI,每次都会创建新的 TCP 连接

// _,_ = fetchDataFromAPI("https://www.example.com")

// _,_ = fetchDataFromAPI("https://www.example.com")

// 使用 fetchDataFromAPIReusable,会复用连接

data, err := fetchDataFromAPIReusable("https://httpbin.org/get")

if err != nil {

fmt.Printf("请求错误: %v\n", err)

return

}

fmt.Printf("获取到数据 (部分): %s...\n", data[:50])

data, err = fetchDataFromAPIReusable("https://httpbin.org/get")

if err != nil {

fmt.Printf("请求错误: %v\n", err)

return

}

fmt.Printf("再次获取到数据 (部分): %s...\n", data[:50])

}

问题分析:

http.Client 的零值或通过 &http.Client{} 创建的实例,其内部的 Transport 字段(通常是 *http.Transport)会维护一个 TCP 连接池,并处理 HTTP keep-alive 等机制以复用连接。如果为每个请求都创建一个新的 http.Client,那么每次请求都会经历完整的 TCP 连接建立过程(三次握手),并在请求结束后关闭连接。

危害:

- 性能下降: 频繁的 TCP 连接建立和关闭开销巨大。

- 资源消耗增加: 短时间内大量创建连接可能导致客户端耗尽可用端口,或者服务器端累积大量 TIME_WAIT 状态的连接,最终影响整个系统的吞吐量和稳定性。

避坑指南:

- 复用 http.Client 实例: 这是官方推荐的最佳实践。可以在全局范围创建一个 http.Client 实例(如 http.DefaultClient,或者一个自定义配置的实例),并在所有需要发起 HTTP 请求的地方复用它。

- http.Client 是并发安全的: 你可以放心地在多个 goroutine 中共享和使用同一个 http.Client 实例。

- 自定义 Transport: 如果需要更细致地控制连接池大小、超时时间、TLS 配置等,可以创建一个自定义的 http.Transport 并将其赋给 http.Client 的 Transport 字段。

坏味道五:API 设计的“文档缺失”——“这参数啥意思?猜猜看!”

良好的 API 设计是软件质量的基石,而清晰、准确的文档则是 API 可用性的关键。然而,在实际项目中,我们常常会遇到一些 API,其参数、返回值、错误码、甚至行为语义都缺乏明确的文档说明,导致用户(调用方)在集成时只能靠“猜”或者阅读源码,极易产生误用。

典型场景:一个“凭感觉”调用的服务发现 API

假设我们有一个类似 Nacos Naming 的服务发现客户端,其 GetInstance API 的文档非常简略,或者干脆没有文档,只暴露了函数签名:

package main

import (

"errors"

"fmt"

"math/rand"

"time"

)

// 假设这是 Nacos Naming 客户端的一个简化接口

type NamingClient interface {

// GetInstance 获取服务实例。

// 关键问题:

// 1. serviceName 需要包含 namespace/group 信息吗?格式是什么?

// 2. clusters 是可选的吗?如果提供多个,是随机选一个还是有特定策略?

// 3. healthyOnly 如果为 true,是否会过滤掉不健康的实例?如果不健康实例是唯一选择呢?

// 4. 返回的 instance 是什么结构?如果找不到实例,是返回 nil, error 还是空对象?

// 5. error 可能有哪些类型?调用方需要如何区分处理?

// 6. 这个调用是阻塞的吗?超时机制是怎样的?

// 7. 是否有本地缓存机制?缓存刷新策略是?

GetInstance(serviceName string, clusters []string, healthyOnly bool) (instance interface{}, err error)

}

// 一个非常简化的模拟实现 (坏味道的 API 设计,文档缺失)

type MockNamingClient struct{}

func (c *MockNamingClient) GetInstance(serviceName string, clusters []string, healthyOnly bool) (interface{}, error) {

fmt.Printf("尝试获取服务: %s, 集群: %v, 只获取健康实例: %t\n", serviceName, clusters, healthyOnly)

// 模拟一些内部逻辑和不确定性

if serviceName == "" {

return nil, errors.New("服务名不能为空 (错误码: Naming-1001)") // 文档里有这个错误码说明吗?

}

// 假设我们内部有一些实例数据

instances := map[string][]string{

"OrderService": {"10.0.0.1:8080", "10.0.0.2:8080"},

"PaymentService": {"10.0.1.1:9090"},

}

// 模拟集群选择逻辑 (文档缺失,用户只能猜)

selectedCluster := ""

if len(clusters) > 0 {

selectedCluster = clusters[rand.Intn(len(clusters))] // 随机选一个?

fmt.Printf("选择了集群: %s\n", selectedCluster)

}

// 模拟健康检查和实例返回 (文档缺失)

if healthyOnly && rand.Float32() < 0.3 { // 30% 概率找不到健康实例

return nil, fmt.Errorf("在集群 %s 中未找到 %s 的健康实例 (错误码: Naming-2003)", selectedCluster, serviceName)

}

if insts, ok := instances[serviceName]; ok && len(insts) > 0 {

return insts[rand.Intn(len(insts))], nil // 返回一个实例地址

}

return nil, fmt.Errorf("服务 %s 未找到 (错误码: Naming-4004)", serviceName)

}

func main() {

client := &MockNamingClient{}

// 用户A的调用 (基于猜测)

fmt.Println("用户A 调用:")

instA, errA := client.GetInstance("OrderService", []string{"clusterA", "clusterB"}, true)

if errA != nil {

fmt.Printf("用户A 获取实例失败: %v\n", errA)

} else {

fmt.Printf("用户A 获取到实例: %v\n", instA)

}

fmt.Println("\n用户B 的调用 (换一种猜测):")

// 用户B 可能不知道 serviceName 需要什么格式,或者 clusters 参数的意义

instB, errB := client.GetInstance("com.example.PaymentService", nil, false) // serviceName 格式?clusters 为 nil 会怎样?

if errB != nil {

fmt.Printf("用户B 获取实例失败: %v\n", errB)

} else {

fmt.Printf("用户B 获取到实例: %v\n", instB)

}

}

问题分析:

当 API 的设计者没有提供清晰、详尽的文档来说明每个参数的含义、取值范围、默认行为、边界条件、错误类型以及API的整体行为和副作用时,API 的使用者就只能依赖猜测、尝试,甚至阅读源码(如果开源的话)来理解如何正确调用。

危害:

- 极易误用: 用户可能以 API 设计者未预期的方式调用接口,导致程序行为不符合预期,甚至引发错误。

- 集成成本高: 理解和调试一个文档不清晰的 API 非常耗时。

- 脆弱的依赖: 当 API 的内部实现或未明确定义的行为发生变化时,依赖这些隐性行为的调用方代码很可能会中断。

- 难以排查问题: 出现问题时,很难判断是调用方使用不当,还是 API 本身的缺陷。

避坑指南 (针对 API 设计者):

- 编写清晰、准确、详尽的文档是 API 设计不可或缺的一部分! 这不仅仅是注释,可能还包括独立的 API 参考手册、用户指南和最佳实践。

- 参数和返回值要有明确的语义: 名称应自解释,复杂类型应有结构和字段说明。

- 例如,serviceName 是否需要包含命名空间或分组信息?格式是什么?

- clusters 参数是可选的吗?如果提供多个,选择策略是什么?是轮询、随机还是有特定优先级?

- healthyOnly 的确切行为是什么?如果没有健康的实例,是返回错误还是有其他回退逻辑?

- 明确约定边界条件和错误情况:

- 哪些参数是必需的,哪些是可选的?可选参数的默认值是什么?

- 对于无效输入,API 会如何响应?返回哪些具体的错误码或错误信息?(例如,示例中的 Naming-1001, Naming-2003, Naming-4004 是否有统一的文档说明其含义和建议处理方式?)

- API 调用可能产生的副作用是什么?

- 提供清晰的调用示例: 针对常见的用例,提供可运行的代码示例。

- 考虑 API 的易用性和健壮性:

- 是否需要版本化?

- 是否需要幂等性保证?

- 认证和授权机制是否清晰?

- 超时和重试策略是怎样的?

- 将 API 的使用者视为首要客户: 站在使用者的角度思考,他们需要哪些信息才能轻松、正确地使用你的 API。

对于 API 的使用者: 当遇到文档不清晰的 API 时,除了“猜测”,更积极的做法是向 API 提供方寻求澄清,或者在有条件的情况下,参与到 API 文档的改进和完善中。

在之前《API设计的“Go境界”:Go团队设计MCP SDK过程中的取舍与思考》一文中,我们了见识了Go团队的API设计艺术,大家可以认知阅读和参考。

坏味道六:匿名函数类型签名的“笨拙感”——“这函数参数看着眼花缭乱!”

Go 语言的函数是一等公民,可以作为参数传递,也可以作为返回值。这为编写高阶函数和实现某些设计模式提供了极大的灵活性。然而,当匿名函数的类型签名(特别是嵌套或包含多个复杂函数类型参数时)直接写在函数定义中时,代码的可读性会大大降低,显得冗余和笨拙。

典型场景:复杂的函数签名

package main

import (

"errors"

"fmt"

"strings"

)

// 坏味道:函数签名中直接嵌入复杂的匿名函数类型

func processData(

data []string,

filterFunc func(string) bool, // 参数1:一个过滤函数

transformFunc func(string) (string, error), // 参数2:一个转换函数

aggregatorFunc func([]string) string, // 参数3:一个聚合函数

) (string, error) {

var filteredData []string

for _, d := range data {

if filterFunc(d) {

transformed, err := transformFunc(d)

if err != nil {

// 注意:这里为了简化,直接返回了第一个遇到的错误

// 实际应用中可能需要更复杂的错误处理逻辑,比如收集所有错误

return "", fmt.Errorf("转换 '%s' 失败: %w", d, err)

}

filteredData = append(filteredData, transformed)

}

}

if len(filteredData) == 0 {

return "", errors.New("没有数据需要聚合")

}

return aggregatorFunc(filteredData), nil

}

// 使用 type 定义函数类型别名,代码更清晰

type StringFilter func(string) bool

type StringTransformer func(string) (string, error)

type StringAggregator func([]string) string

func processDataWithTypeAlias(

data []string,

filter StringFilter,

transform StringTransformer,

aggregate StringAggregator,

) (string, error) {

// 函数体与 processData 相同

var filteredData []string

for _, d := range data {

if filter(d) {

transformed, err := transform(d)

if err != nil {

return "", fmt.Errorf("转换 '%s' 失败: %w", d, err)

}

filteredData = append(filteredData, transformed)

}

}

if len(filteredData) == 0 {

return "", errors.New("没有数据需要聚合")

}

return aggregate(filteredData), nil

}

func main() {

sampleData := []string{" apple ", "Banana", " CHERRY ", "date"}

// 使用原始的 processData,函数调用时也可能显得冗长

result, err := processData(

sampleData,

func(s string) bool { return len(strings.TrimSpace(s)) > 0 },

func(s string) (string, error) {

trimmed := strings.TrimSpace(s)

if strings.ToLower(trimmed) == "banana" { // 假设banana是不允许的

return "", errors.New("包含非法水果banana")

}

return strings.ToUpper(trimmed), nil

},

func(s []string) string { return strings.Join(s, ", ") },

)

if err != nil {

fmt.Printf("处理错误 (原始方式): %v\n", err)

} else {

fmt.Printf("处理结果 (原始方式): %s\n", result)

}

// 使用 processDataWithTypeAlias,定义和调用都更清晰

filter := func(s string) bool { return len(strings.TrimSpace(s)) > 0 }

transformer := func(s string) (string, error) {

trimmed := strings.TrimSpace(s)

if strings.ToLower(trimmed) == "banana" {

return "", errors.New("包含非法水果banana")

}

return strings.ToUpper(trimmed), nil

}

aggregator := func(s []string) string { return strings.Join(s, ", ") }

resultTyped, errTyped := processDataWithTypeAlias(sampleData, filter, transformer, aggregator)

if errTyped != nil {

fmt.Printf("处理错误 (类型别名方式): %v\n", errTyped)

} else {

fmt.Printf("处理结果 (类型别名方式): %s\n", resultTyped)

}

}

问题分析:

Go 语言的类型系统是强类型且显式的。函数类型本身也是一种类型。当我们将一个函数类型(特别是具有多个参数和返回值的复杂函数类型)直接作为另一个函数的参数类型或返回值类型时,会导致函数签名变得非常长,难以阅读和理解。这与 Go 追求简洁和可读性的哲学在观感上有所冲突。

避坑指南:

- 使用 type 关键字定义函数类型别名: 这是解决此类问题的最推荐、最地道也是最常见的方法。通过为复杂的函数签名定义一个有意义的类型名称,可以极大地提高代码的可读性和可维护性。如示例中的 StringFilter, StringTransformer, StringAggregator。

- 何时可以不使用类型别名:

- 当函数签名非常简单(例如 func() 或 func(int) int)且该函数类型只在局部、极少数地方使用时,直接写出可能问题不大。

- 但一旦函数签名变复杂,或者该函数类型需要在多个地方使用(作为不同函数的参数或返回值,或者作为结构体字段类型),就应该毫不犹豫地使用类型别名。

- 理解背后的设计考量: Go 语言强调类型的明确性。虽然直接写出函数类型显得“笨拙”,但也保证了类型信息在代码中的完全显露,避免了某些动态语言中因类型不明确可能导致的困惑。类型别名则是在这种明确性的基础上,提供了提升可读性的手段。

为了更好地简化匿名函数,Go团队也提出了关于引入轻量级匿名函数语法的提案(Issue #21498),该提案一直是社区讨论的焦点,它旨在提供一种更简洁的方式来定义匿名函数,尤其是当函数类型可以从上下文推断时,从而减少样板代码,提升代码的可读性和编写效率。

小结:于细微处见真章,持续打磨代码品质

今天我们复盘的这六个 Go 编码“坏味道”——异步时序混乱、指针闭包陷阱、不当的错误处理、http.Client 误用、文档缺失的 API 以及冗长的函数签名——可能只是我们日常开发中遇到问题的冰山一角。

它们中的每一个,看似都是细节问题,但“千里之堤,溃于蚁穴”。正是这些细节的累积,最终决定了我们软件产品的质量、系统的稳定性和团队的开发效率。

识别并规避这些“坏味道”,需要我们:

- 深入理解 Go 语言的特性和设计哲学。

- 培养严谨的工程思维和对细节的关注。

- 重视代码审查,从他人的错误和经验中学习。

- 持续学习,不断反思和总结自己的编码实践。

希望今天的分享能给大家带来一些启发。让我们一起努力,写出更少“坑”、更高质量的 Go 代码!

聊一聊,也帮个忙:

- 在你日常的 Go 开发或 Code Review 中,还遇到过哪些让你印象深刻的“编码坏味道”?

- 对于今天提到的这些问题,你是否有自己独特的解决技巧或更深刻的理解?

- 你认为在团队中推广良好的编码规范和实践,最有效的方法是什么?

欢迎在评论区留下你的经验、思考和问题。如果你觉得这篇文章对你有帮助,也请转发给你身边的 Gopher 朋友们,让我们一起在 Go 的道路上精进!

想与我进行更深入的 Go 语言、编码实践与 AI 技术交流吗? 欢迎加入我的“Go & AI 精进营”知识星球。

我们星球见!

商务合作方式:撰稿、出书、培训、在线课程、合伙创业、咨询、广告合作。如有需求,请扫描下方公众号二维码,与我私信联系。

© 2025, bigwhite. 版权所有.

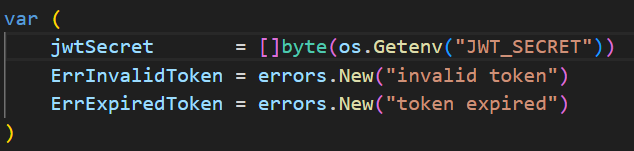

后来 CopperKoi 想到前端把 JWT 放在 Authorization Header 不依赖 Cookies 就可以让 csrf 几乎不可能实现。

后来 CopperKoi 想到前端把 JWT 放在 Authorization Header 不依赖 Cookies 就可以让 csrf 几乎不可能实现。