本文永久链接 – https://tonybai.com/2026/01/12/victoriametrics-guide-most-efficient-go-code

大家好,我是Tony Bai。

在 InfluxDB 转Rust 之后,VictoriaMetrics 迅速崛起,成为了 Go 生态中无可争议的第一时序数据库。凭借其惊人的写入性能、极低的内存占用以及对 Prometheus 生态的完美兼容,它赢得了大量Go开发者以及大厂的青睐。除了核心数据库,其家族还拥有 VictoriaLogs、VictoriaTraces 等明星产品,它们共同构成了一个高性能的可观测性平台。

很多 Gopher 都好奇:为什么用同样的语言,VictoriaMetrics 能跑得这么快、省这么多内存?

答案就藏在它的源码里。VictoriaMetrics 的代码库堪称一本活着的“Go 高性能编程教科书”。从基础的工程规范,到极致的内存复用,再到对并发模型的精细控制,每一行代码都是对性能的极致追求。

今天,我们就来完整拆解 VictoriaMetrics 的核心编程模式,带你体验一场从入门到极致的 Go 性能进阶之旅。

入门——务实的工程基石

在追求极致性能之前,首先要保证代码是稳健且可维护的。VictoriaMetrics 在基础工程实践上,展现了极其实用主义的智慧。

日志系统的“自我保护” (Rate Limiting)

很多系统挂掉,不是因为 bug,而是因为错误引发的“日志风暴”耗尽了磁盘 I/O。VictoriaMetrics 教我们的第一课是:日志也需要限流。

它不仅支持INFO/WARN/ERROR/FATAL/PANIC五级日志,以及默认支持 JSON 格式输出,便于结构化日志采集:

// lib/logger/logger.go

var (

loggerLevel = flag.String("loggerLevel", "INFO", "Minimum level of errors to log. Possible values: INFO, WARN, ERROR, FATAL, PANIC")

loggerFormat = flag.String("loggerFormat", "default", "Format for logs. Possible values: default, json")

)

更引入了关键的限流参数,防止日志风暴导致磁盘 IO 过载:

// lib/logger/logger.go

var (

// 启动参数控制日志级别和限流阈值

errorsPerSecondLimit = flag.Int("loggerErrorsPerSecondLimit", 0, "Per-second limit on the number of ERROR messages...")

warnsPerSecondLimit = flag.Int("loggerWarnsPerSecondLimit", 0, Per-second limit on the number of WARN messages. If more than the given number of warns are emitted per second, then the remaining warns are suppressed. Zero values disable the rate limit)

)

在输出日志时,根据日志限流配置,对ERROR和WARN级别日志进行限制:

func logMessage(level, msg string, skipframes int) {

... ...

// rate limit ERROR and WARN log messages with given limit.

if level == "ERROR" || level == "WARN" {

limit := uint64(*errorsPerSecondLimit)

if level == "WARN" {

limit = uint64(*warnsPerSecondLimit)

}

ok, suppressMessage := logLimiter.needSuppress(location, limit)

if ok {

return

}

if len(suppressMessage) > 0 {

msg = suppressMessage + msg

}

}

... ...

在你的高并发服务中,给 Error 日志加上限流开关。虽然可能丢失部分细节,但它能保护你的系统不被日志拖垮。

配置管理:Flag 的艺术

VictoriaMetrics 并未使用第三方的flag包,而是大量使用标准库 flag 包,但用得非常智能。它为每个配置项提供了清晰文档和合理默认值,并支持通过 lib/envflag 内部包从环境变量覆盖配置。这种设计既简单又符合云原生部署需求:

// lib/envflag/envflag.go

var (

// -envflag.enable: 启用从环境变量读取标志

enable = flag.Bool("envflag.enable", false, "Whether to enable reading flags from environment variables in addition to the command line. "+

"Command line flag values have priority over values from environment vars. "+

"Flags are read only from the command line if this flag isn't set. See https://docs.victoriametrics.com/victoriametrics/single-server-victoriametrics/#environment-variables for more details")

// -envflag.prefix: 环境变量前缀

prefix = flag.String("envflag.prefix", "", "Prefix for environment variables if -envflag.enable is set")

)

// Parse parses environment vars and command-line flags.

//

// Flags set via command-line override flags set via environment vars.

//

// This function must be called instead of flag.Parse() before using any flags in the program.

func Parse() {

ParseFlagSet(flag.CommandLine, os.Args[1:])

applySecretFlags()

}

模块化与克制的抽象

打开源码目录,你会发现

VictoriaMetrics 将功能拆分为独立的 lib 包,每个包职责单一:

- lib/storage: 核心存储引擎

- lib/mergeset: 合并索引

- lib/encoding: 数据编码

- lib/bytesutil: 字节工具函数

- lib/workingsetcache: 工作集缓存

在VictoriaMetrics代码中,你很少能看到层层嵌套的接口或复杂的依赖注入框架。 这种结构既保持了模块化,又避免了过度抽象带来的性能损耗,

对于 CPU 密集型应用,函数调用的层级越少越好。简单、直接的代码不仅易于阅读,对编译器优化(如内联)也更友好。

进阶——内存管理的艺术

对于数据库而言,内存就是生命线。VictoriaMetrics 在内存管理上的造诣,是其高性能的核心秘诀之一。

sync.Pool 的高效对象复用模式

Go 的 GC 在处理海量小对象时会面临巨大压力。VictoriaMetrics 的策略是:能复用,绝不分配。 VictoriaMetrics 大量使用 sync.Pool 来复用对象,减少 GC 压力。它不仅复用简单的结构体,甚至复用复杂的切片对象,比如下面这段复用切片对象的代码。

// lib/encoding/int.go

var uint64sPool sync.Pool

// Uint64s holds an uint64 slice

type Uint64s struct {

A []uint64

}

// GetUint64s returns an uint64 slice with the given size.

// The slice contents isn't initialized - it may contain garbage.

func GetUint64s(size int) *Uint64s {

v := uint64sPool.Get()

if v == nil {

return &Uint64s{

A: make([]uint64, size),

}

}

is := v.(*Uint64s)

// 关键技巧:复用底层数组,仅调整切片长度

// 避免了重新 make([]uint64) 的开销

is.A = slicesutil.SetLength(is.A, size)

return is

}

// PutUint64s returns is to the pool.

func PutUint64s(is *Uint64s) {

uint64sPool.Put(is)

}

这里用到了 slicesutil.SetLength,通过切片操作复用底层数组,避免了重新分配内存:

// lib/slicesutil/slicesutil.go

// SetLength sets len(a) to newLen and returns the result.

//

// It may allocate new slice if cap(a) is smaller than newLen.

func SetLength[T any](a []T, newLen int) []T {

if n := newLen - cap(a); n > 0 {

a = append(a[:cap(a)], make([]T, n)...)

}

return a[:newLen]

}

突破 sync.Pool 的限制:Channel 对象池

sync.Pool 虽好,但它有两个缺点:它是 per-CPU 的,且在 GC 时会被清空。对于极大的对象(如超过 64KB 的缓冲区),这可能导致内存使用量的不可控膨胀。

VictoriaMetrics 教你一招:用 Channel 当对象池,比 sync.Pool 更可控。

// lib/storage/inmemory_part.go

// inmemoryPart represents in-memory partition.

type inmemoryPart struct {

ph partHeader

timestampsData chunkedbuffer.Buffer

valuesData chunkedbuffer.Buffer

indexData chunkedbuffer.Buffer

metaindexData chunkedbuffer.Buffer

creationTime uint64

}

// 容量严格限制为 CPU 核数,防止内存无限膨胀

// Use chan instead of sync.Pool in order to reduce memory usage on systems with big number of CPU cores,

// since sync.Pool maintains per-CPU pool of inmemoryPart objects.

//

// The inmemoryPart object size can exceed 64KB, so it is better to use chan instead of sync.Pool for reducing memory usage.

var mpPool = make(chan *inmemoryPart, cgroup.AvailableCPUs())

func getInmemoryPart() *inmemoryPart {

select {

case mp := <-mpPool: // 尝试从池中获取

return mp

default:

return &inmemoryPart{} // 池空了,才新建

}

}

func putInmemoryPart(mp *inmemoryPart) {

mp.Reset()

select {

case mpPool <- mp: // 尝试归还

default:

// Drop mp in order to reduce memory usage.

// 池满了,直接丢弃,等待 GC 回收

}

}

VictoriaMetrics认为:当你需要严格控制大对象的总数量时,带缓冲的 Channel 是比 sync.Pool 更安全的选择。

切片复用的极致:[:0] 技巧

在处理数据流时,VictoriaMetrics 几乎从不通过 make 创建新切片,而是疯狂复用缓冲区。最常用的模式就是 buf = buf[:0],该模式清空切片但保留和重用底层数组,避免重新分配新切片(包括底层数组):

// lib/mergeset/encoding.go

func (ib *inmemoryBlock) updateCommonPrefixSorted() {

items := ib.items

if len(items) <= 1 {

// There is no sense in duplicating a single item or zero items into commonPrefix,

// since this only can increase blockHeader size without any benefits.

ib.commonPrefix = ib.commonPrefix[:0] // 重置切片长度为 0,但保留底层容量 (capacity)

return

}

data := ib.data

cp := items[0].Bytes(data)

cpLen := commonPrefixLen(cp, items[len(items)-1].Bytes(data))

cp = cp[:cpLen]

ib.commonPrefix = append(ib.commonPrefix[:0], cp...) // append 操作会直接利用底层数组,无内存分配

}

智能的缓冲区分配策略

并不总是越大越好。VictoriaMetrics 实现了三种精细的缓冲区调整策略 (lib/bytesutil):

- ResizeWithCopyMayOverallocate:按 2 的幂次增长(减少未来扩容次数,空间换时间)。

- ResizeWithCopyNoOverallocate:精确分配(节省内存,时间换空间)。

- ResizeNoCopy…:扩容但不拷贝旧数据(用于完全覆盖写入场景,最快)。

过度分配可节省 CPU 但浪费内存;精确分配节省内存但可能频繁扩容,究竟使用哪种调整策略,需要根据实际情况权衡。

高级——并发与锁的智慧

面对高并发,如何让多核 CPU 跑满而不互相打架?

分片锁 (Sharding):化整为零

这是解决锁竞争的“银弹”。VictoriaMetrics 将大的数据结构拆分为多个分片,每个分片有独立的锁。

// lib/storage/partition.go

// The number of shards for rawRow entries per partition.

//

// Higher number of shards reduces CPU contention and increases the max bandwidth on multi-core systems.

// 1. 根据 CPU 核数决定分片数量

var rawRowsShardsPerPartition = cgroup.AvailableCPUs()

type rawRowsShards struct {

flushDeadlineMs atomic.Int64

shardIdx atomic.Uint32

// Shards reduce lock contention when adding rows on multi-CPU systems.

// 2. 创建一组分片,每个分片有独立的锁

shards []rawRowsShard

rowssToFlushLock sync.Mutex

rowssToFlush [][]rawRow

}

func (rrss *rawRowsShards) addRows(pt *partition, rows []rawRow) {

shards := rrss.shards

shardsLen := uint32(len(shards))

for len(rows) > 0 {

n := rrss.shardIdx.Add(1)

idx := n % shardsLen

tailRows, rowsToFlush := shards[idx].addRows(rows) // 在分片中添加row

rrss.addRowsToFlush(pt, rowsToFlush)

rows = tailRows

}

}

func (rrs *rawRowsShard) addRows(rows []rawRow) ([]rawRow, []rawRow) {

var rowsToFlush []rawRow

rrs.mu.Lock() // 只锁定这一个分片,其他分片仍可并发写入

if cap(rrs.rows) == 0 {

rrs.rows = newRawRows()

}

if len(rrs.rows) == 0 {

rrs.updateFlushDeadline()

}

n := copy(rrs.rows[len(rrs.rows):cap(rrs.rows)], rows)

rrs.rows = rrs.rows[:len(rrs.rows)+n]

rows = rows[n:]

if len(rows) > 0 {

rowsToFlush = rrs.rows

rrs.rows = newRawRows()

rrs.updateFlushDeadline()

n = copy(rrs.rows[:cap(rrs.rows)], rows)

rrs.rows = rrs.rows[:n]

rows = rows[n:]

}

rrs.mu.Unlock() // 解除分片锁

return rows, rowsToFlush

}

原子操作:无锁编程

对于简单的计数器和状态标志操作这种简单逻辑,VictoriaMetrics 大量使用 atomic 包替代 Mutex。在 Bloom Filter (lib/bloomfilter/filter.go) 中,它更是使用 atomic.LoadUint64 和 atomic.CompareAndSwapUint64 (CAS) 来实现无锁并发位设置,性能比互斥锁快 10-100 倍。

// lib/bloomfilter/filter.go

func (f *filter) Has(h uint64) bool {

bits := f.bits

maxBits := uint64(len(bits)) * 64

bp := (*[8]byte)(unsafe.Pointer(&h))

b := bp[:]

for i := 0; i < hashesCount; i++ {

hi := xxhash.Sum64(b)

h++

idx := hi % maxBits

i := idx / 64

j := idx % 64

mask := uint64(1) << j

w := atomic.LoadUint64(&bits[i])

if (w & mask) == 0 {

return false

}

}

return true

}

func (f *filter) Add(h uint64) bool {

bits := f.bits

maxBits := uint64(len(bits)) * 64

bp := (*[8]byte)(unsafe.Pointer(&h))

b := bp[:]

isNew := false

for i := 0; i < hashesCount; i++ {

hi := xxhash.Sum64(b)

h++

idx := hi % maxBits

i := idx / 64

j := idx % 64

mask := uint64(1) << j

w := atomic.LoadUint64(&bits[i])

for (w & mask) == 0 {

wNew := w | mask

// The wNew != w most of the time, so there is no need in using atomic.LoadUint64

// in front of atomic.CompareAndSwapUint64 in order to try avoiding slow inter-CPU synchronization.

if atomic.CompareAndSwapUint64(&bits[i], w, wNew) {

isNew = true

break

}

w = atomic.LoadUint64(&bits[i])

}

}

return isNew

}

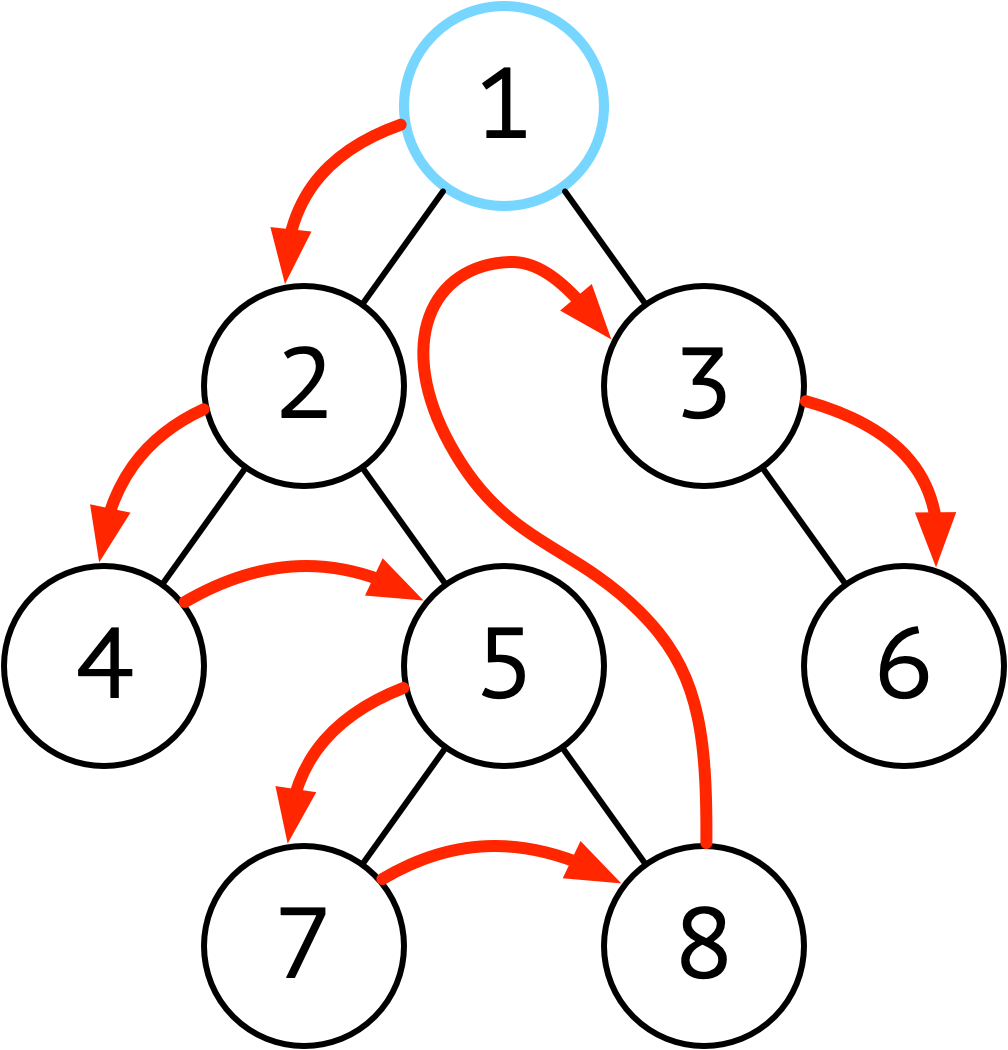

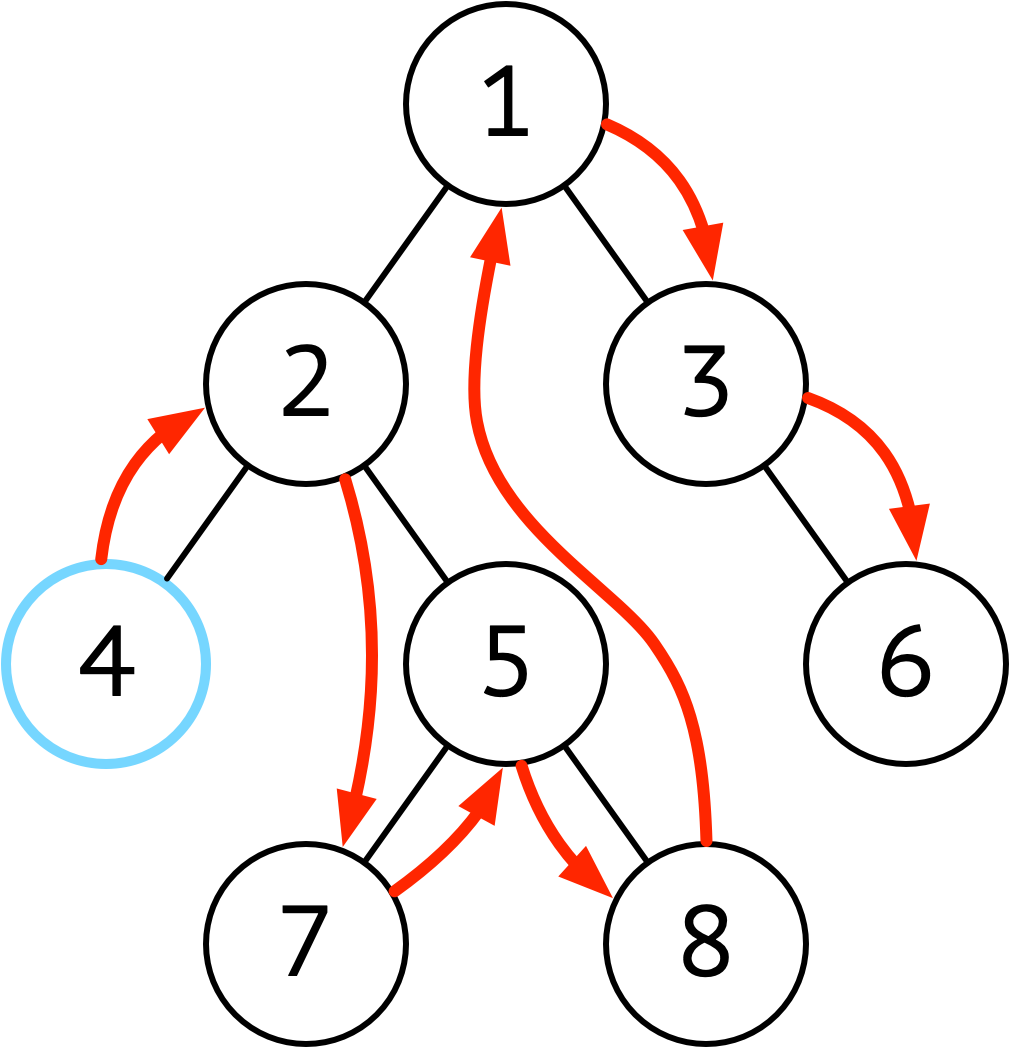

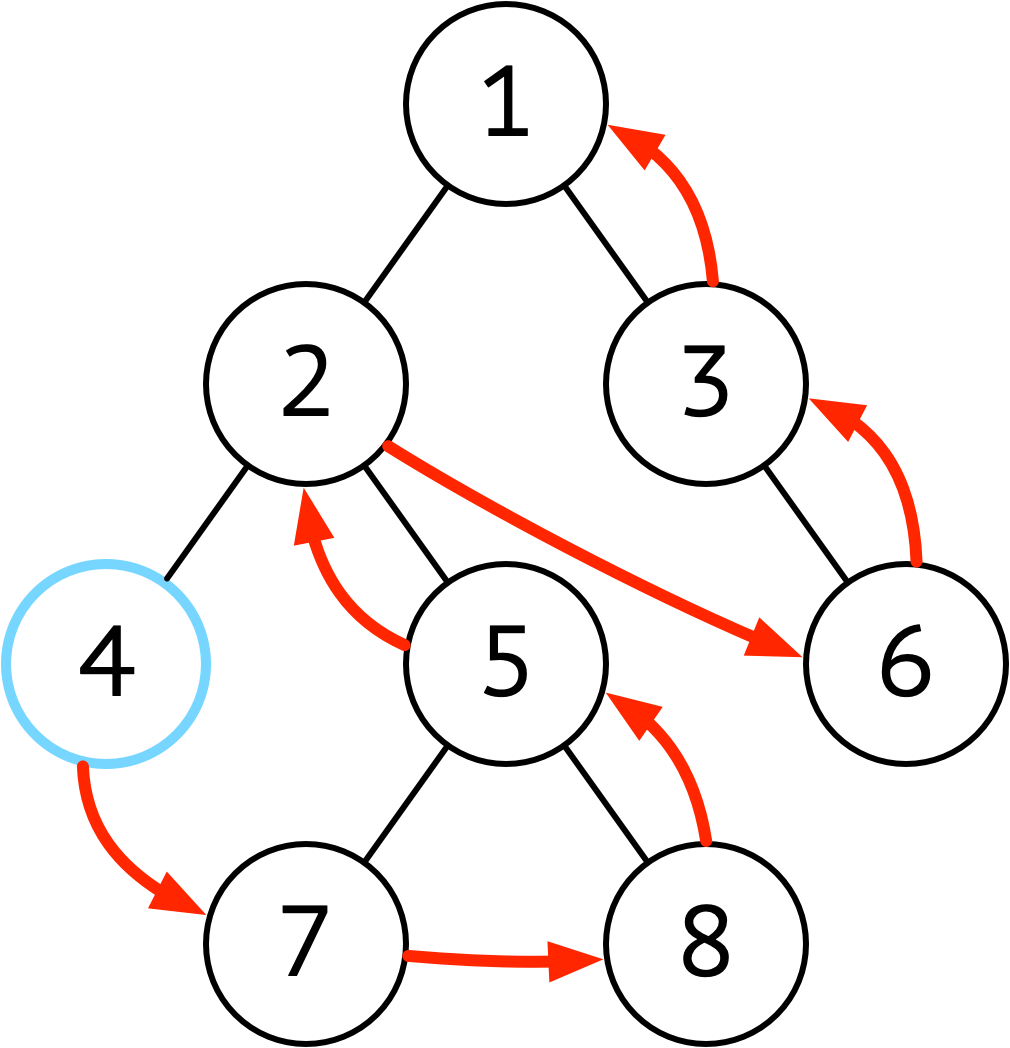

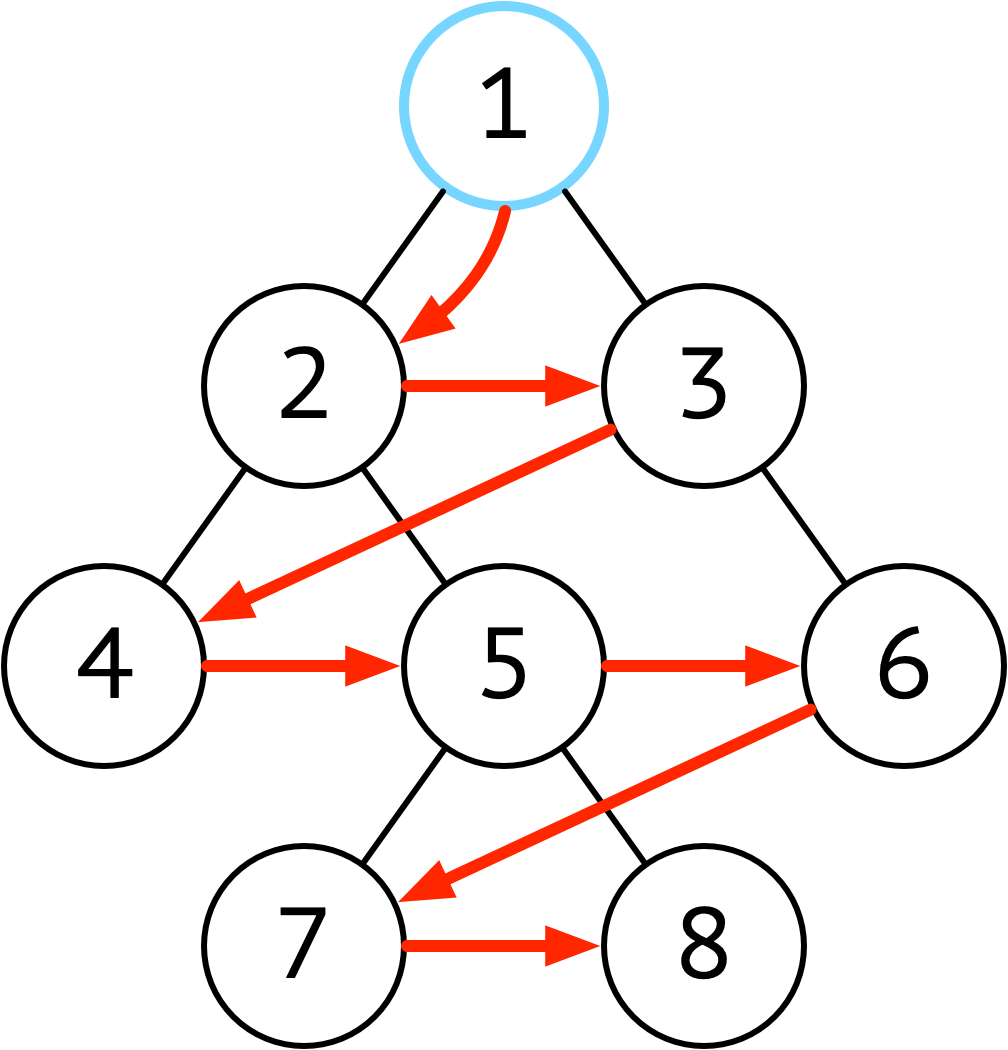

本地化 Worker Pool:消除 CPU 间通信

通用的 Worker Pool 有一个全局任务队列,这会导致多个 CPU 核心竞争同一个锁,且任务在不同核心间切换会带来缓存失效。

VictoriaMetrics 实现了一种本地化优先的 Worker Pool:每个 Worker 优先处理分配给自己的任务(通过独立的 Channel),只有在空闲时才去“帮助”其他 Worker。这种设计极大提升了多核系统的可扩展性。

// app/vmselect/netstorage/netstorage.go

// MaxWorkers returns the maximum number of concurrent goroutines, which can be used by RunParallel()

func MaxWorkers() int {

n := *maxWorkersPerQuery

if n <= 0 {

return defaultMaxWorkersPerQuery

}

if n > gomaxprocs {

// There is no sense in running more than gomaxprocs CPU-bound concurrent workers,

// since this may worsen the query performance.

n = gomaxprocs

}

return n

}

var gomaxprocs = cgroup.AvailableCPUs()

// 根据 CPU 核数动态决定 worker 数量(最多 32 个)

var defaultMaxWorkersPerQuery = func() int {

// maxWorkersLimit is the maximum number of CPU cores, which can be used in parallel

// for processing an average query, without significant impact on inter-CPU communications.

const maxWorkersLimit = 32

n := min(gomaxprocs, maxWorkersLimit)

return n

}()

func (rss *Results) runParallel(qt *querytracer.Tracer, f func(rs *Result, workerID uint) error) (int, error) {

tswsLen := len(rss.packedTimeseries)

if tswsLen == 0 {

// Nothing to process

return 0, nil

}

var mustStop atomic.Bool

initTimeseriesWork := func(tsw *timeseriesWork, pts *packedTimeseries) {

tsw.rss = rss

tsw.pts = pts

tsw.f = f

tsw.mustStop = &mustStop

}

maxWorkers := MaxWorkers()

if maxWorkers == 1 || tswsLen == 1 {

// It is faster to process time series in the current goroutine.

var tsw timeseriesWork

tmpResult := getTmpResult()

rowsProcessedTotal := 0

var err error

for i := range rss.packedTimeseries {

initTimeseriesWork(&tsw, &rss.packedTimeseries[i])

err = tsw.do(&tmpResult.rs, 0)

rowsReadPerSeries.Update(float64(tsw.rowsProcessed))

rowsProcessedTotal += tsw.rowsProcessed

if err != nil {

break

}

}

putTmpResult(tmpResult)

return rowsProcessedTotal, err

}

// Slow path - spin up multiple local workers for parallel data processing.

// Do not use global workers pool, since it increases inter-CPU memory ping-pong,

// which reduces the scalability on systems with many CPU cores.

// Prepare the work for workers.

tsws := make([]timeseriesWork, len(rss.packedTimeseries))

for i := range rss.packedTimeseries {

initTimeseriesWork(&tsws[i], &rss.packedTimeseries[i])

}

// Prepare worker channels.

workers := min(len(tsws), maxWorkers)

itemsPerWorker := (len(tsws) + workers - 1) / workers

// 为每个 Worker 创建独立的 Channel

workChs := make([]chan *timeseriesWork, workers)

for i := range workChs {

workChs[i] = make(chan *timeseriesWork, itemsPerWorker)

}

// Spread work among workers.

for i := range tsws {

idx := i % len(workChs)

workChs[idx] <- &tsws[i]

}

// Mark worker channels as closed.

for _, workCh := range workChs {

close(workCh)

}

// Start workers and wait until they finish the work.

var wg sync.WaitGroup

for i := range workChs {

wg.Add(1)

qtChild := qt.NewChild("worker #%d", i)

go func(workerID uint) {

// Worker 优先处理自己 Channel 中的任务

timeseriesWorker(qtChild, workChs, workerID)

qtChild.Done()

wg.Done()

}(uint(i))

}

wg.Wait()

// Collect results.

var firstErr error

rowsProcessedTotal := 0

for i := range tsws {

tsw := &tsws[i]

if tsw.err != nil && firstErr == nil {

// Return just the first error, since other errors are likely duplicate the first error.

firstErr = tsw.err

}

rowsReadPerSeries.Update(float64(tsw.rowsProcessed))

rowsProcessedTotal += tsw.rowsProcessed

}

return rowsProcessedTotal, firstErr

}

并发度控制:Channel 作为信号量进行限流

为了防止内存溢出,必须严格限制并发处理的数据块数量。VictoriaMetrics 使用带缓冲 Channel 作为信号量来实现限流。

// lib/mergeset/table.go

// Table represents mergeset table.

type Table struct {

... ...

// inmemoryPartsLimitCh limits the number of inmemory parts to maxInmemoryParts

// in order to prevent from data ingestion slowdown as described at https://github.com/VictoriaMetrics/VictoriaMetrics/pull/5212

inmemoryPartsLimitCh chan struct{}

... ...

}

func (tb *Table) addToInmemoryParts(pw *partWrapper, isFinal bool) {

// Wait until the number of in-memory parts goes below maxInmemoryParts.

// This prevents from excess CPU usage during search in tb under high ingestion rate to tb.

// See https://github.com/VictoriaMetrics/VictoriaMetrics/pull/5212

select {

case tb.inmemoryPartsLimitCh <- struct{}{}:

default:

tb.inmemoryPartsLimitReachedCount.Add(1)

select {

case tb.inmemoryPartsLimitCh <- struct{}{}: // 满则阻塞等待

case <-tb.stopCh:

}

}

... ...

}

专家——黑魔法与算法优化

当常规手段用尽,VictoriaMetrics 开始使用一些“非常规”武器。

Unsafe 的零拷贝技巧

Go 的 string 和 []byte 转换通常涉及内存拷贝。在热点路径上,VictoriaMetrics 使用 unsafe 绕过。

// lib/bytesutil/bytesutil.go

// 零拷贝:[]byte -> string

func ToUnsafeString(b []byte) string {

return unsafe.String(unsafe.SliceData(b), len(b))

}

// 零拷贝:string -> []byte

func ToUnsafeBytes(s string) []byte {

return unsafe.Slice(unsafe.StringData(s), len(s))

}

此外,它还使用 unsafe.Add 进行直接指针运算来获取子切片,以及直接将 uint64 转为字节数组指针进行哈希计算,这些都可以在热路径上减少了边界检查和内存分配。

警告:这是一把双刃剑。你必须确保原始数据在生命周期内有效且不可变,否则会导致严重的逻辑错误甚至 Panic。

汇编优化与算法选择

VictoriaMetrics 本身并不手写汇编,但它极其善于利用经过汇编优化的第三方库(如 xxhash, zstd)。

更重要的是,它针对时序数据特点,发明了 Nearest Delta 编码(最近邻 Delta 编码)。它不仅存储数值的“差值(delta)”,还通过位运算移除不必要的精度和末尾的零。

它还支持策略自适应,会智能判断数据类型(Gauge vs Counter),选择不同编码。甚至在压缩效果不佳时自动回退到存储原始数据,确保在 CPU 和存储空间之间取得最佳平衡。

内存布局优化:公共前缀提取

在索引存储中,有序数据的 Key 往往有很长的公共前缀。VictoriaMetrics 会自动提取首尾元素的公共前缀,只存储差异部分。这不仅减少了内存占用,更提高了 CPU 缓存的命中率。

小结:Gopher 的修行之路

通过完整剖析 VictoriaMetrics 的源码,我们看到了一条清晰的性能进阶之路:

- 入门:编写简单、直接、模块化的代码,利用 Flag 和日志限流构建稳健系统。

- 进阶:精通内存复用,灵活运用 sync.Pool 和 Channel 对象池,将 GC 压力降至最低。

- 高级:深刻理解并发,利用分片锁、原子操作和本地化队列,压榨多核 CPU 的极限。

- 极致:在热点路径上,敢于使用 unsafe 和自定义算法,通过对数据特征的深刻理解换取最后的性能提升。

性能优化没有黑魔法,只有对原理的深刻理解和对细节的极致打磨。 希望 VictoriaMetrics 的这些实战技巧,能帮助你在 Go 语言的修行之路上,更上一层楼。

你的性能优化“必杀技”

VictoriaMetrics 的代码确实让人叹为观止。在你的 Go 开发生涯中,有没有哪一个性能优化技巧(比如 sync.Pool 或 unsafe)让你印象最深刻,或者真的帮了大忙?

欢迎在评论区分享你的“优化故事”! 让我们一起挖掘更多 Go 语言的性能宝藏。

如果这篇文章让你对 Go 高性能编程有了新的领悟,别忘了点个【赞】和【在看】,并转发给你的团队,好代码值得被更多人看到!

还在为“复制粘贴喂AI”而烦恼?我的新专栏 《AI原生开发工作流实战》 将带你:

- 告别低效,重塑开发范式

- 驾驭AI Agent(Claude Code),实现工作流自动化

- 从“AI使用者”进化为规范驱动开发的“工作流指挥家”

扫描下方二维码,开启你的AI原生开发之旅。

你的Go技能,是否也卡在了“熟练”到“精通”的瓶颈期?

- 想写出更地道、更健壮的Go代码,却总在细节上踩坑?

- 渴望提升软件设计能力,驾驭复杂Go项目却缺乏章法?

- 想打造生产级的Go服务,却在工程化实践中屡屡受挫?

继《Go语言第一课》后,我的《Go语言进阶课》终于在极客时间与大家见面了!

我的全新极客时间专栏 《Tony Bai·Go语言进阶课》就是为这样的你量身打造!30+讲硬核内容,带你夯实语法认知,提升设计思维,锻造工程实践能力,更有实战项目串讲。

目标只有一个:助你完成从“Go熟练工”到“Go专家”的蜕变! 现在就加入,让你的Go技能再上一个新台阶!

商务合作方式:撰稿、出书、培训、在线课程、合伙创业、咨询、广告合作。如有需求,请扫描下方公众号二维码,与我私信联系。

© 2026, bigwhite. 版权所有.