1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

| {'title': 'Exploring Curve Finance: A comprehensive guide',

'publish_time_ts': 1686801600,

'publish_time': '2023-06-15 04:00:00',

'content': 'Ethereum’s network is the home to a wide range of unique projects. Ever since it created the ERC-20 token model, thousands of tokens have been launched. In time, new products have emerged as well, such as dApps, decentralized finance (DeFi) protocols and decentralized exchanges (DEXes). One example of a DEX is Curve Finance, which is Ethereum’s go-to DEX for stablecoin trading. It may not be the largest DEX in Ethereum’s ecosystem, but Curve has certainly left a mark. This guide will explore Curve and explain what it is, how it works and what it has to offer. We will also address the project’s token, CRV, and potential risks of the project. What is Curve Finance? Curve Finance is a decentralized exchange that runs on Ethereum’s network. It specifically functions as a decentralized liquidity pool for stablecoin trading. Unlike other exchanges, it does not use an order book. Instead, it relies on an Automated Market Maker (AMM) model for matching liquidity. Curve was founded by Michael Egorov, who previously co-founded the crypto infrastructure protocol NuCypher, where he also served as CTO. He also founded LoanCoin — a decentralized loans networ. Before getting into crypto, he studied at the Moscow Institute of Physics and Technology and the Swinburne University of Technology. Curve Finance is very easy to use. All that you need is an Ethereum wallet. Once you have this, you can start swapping different stablecoins at very low trading fees. While Uniswap is Ethereum’s biggest DEX, Curve Finance is still the biggest for stablecoins. What is an AMM? An Automated Market Maker (AMM) is a DEX protocol used for matching liquidity. It’s used by Curve Finance, as well as many other DEXes. Its role is to replace an order book and use a pricing algorithm to price assets. That way, digital assets can be traded using liquidity pools, instead of matching buyers and sellers. How does Curve Finance work? Curve is a fully decentralized and permissionless protocol, run by the Curve DAO. Curve DAO token CRV is used as its native cryptocurrency. Thanks to its decentralized nature, anyone can provide liquidity to one or more pools. Smart contracts are utilized to carry out any swap. Smart contracts contain liquidity granted to the DEX by its community. In return, community members receive rewards for offering their tokens. Meanwhile, the tokens are used to match orders submitted to the exchange. By adopting this method, Curve users are able to swap two or more tokens. These swaps can include paired stablecoins or wrapped tokens with the underlying collateral. Stable liquidity pools Curve Finance was launched in 2020 when the decentralized finance sector initially blew up. It emerged with the intention of creating an AMM exchange with low fees and efficient fiat savings accounts. The DEX focuses on stablecoins, which allows investors to avoid some of the more volatile aspects of the crypto industry. Meanwhile, it still allows investors to earn high-interest rates by using lending protocols. Incentives for liquidity providers Since Curve Finance’s model cannot function without liquidity providers, attracting as many as possible is imperative. This is why Curve offers various incentives to its users. For example, Curve Finance offers lower transaction fees in comparison to its competitors such as Uniswap. They also allow users to earn rewards from outside of Curve. This is possible thanks to so-called interoperable tokens. For example, if DAI is lent out on Compound Finance. DAI tokens are then exchanged for cDAI. Curve users can use cDAI in Curve’s own liquidity pools. Curve is also integrated with other projects, such as Yearsn and Synthetix. This allows liquidity providers to maximize their return on investment, which in turn, encourages users to return to the platform and provide liquidity to Curve. But that’s is not all, as there are more ways to profit from providing liquidity on this platform. These include: Trading fees: Liquidity providers earn profits from fees paid by the platform’s traders; High APY: Annual Percentage Yields (APY) for stablecoin deposits on Curve can go quite high; Yield Farming : Any funds deposited into LPs that end up not being utilized are used in other DeFi protocols for extra income; veCRV token: By locking up Curve’s native CRV token, users receive veCRV. After that, veCRV holders can use the tokens to boost their deposit APY even further; Boosted pools: Some Curve Finance pools offer further incentives for additional liquidity. This may include high yields for LPs, and Curve is known for yield farming of stablecoins. With this at their disposal, Curve liquidity providers can mix and match these income streams how they see fit. It’s in their interest to earn as much as possible in exchange for the use of their tokens. Curve Finance (CRV) token Back in August 2020, Curve Finance began seeking full decentralization through decentralized governance. In order to achieve this, they launched a Decentralized Autonomous Organization, or DAO, for short. Like other DAOs, Curve Finance introduced their native token, CRV. Following the launch of CRV, Curve released a distribution schedule that is expected to be completed by 2026. The total supply of 3.03b is distributed as such: 62% to community liquidity providers 30% to shareholders (team and investors) with 2-4 years vesting 3% to employees with 2 years vesting Curve DAO token, CRV, grants its holders with voting rights, allowing them to vote on various proposals. They can also make proposals themselves, and let the rest of the community vote on it. Anyone with CRV tokens that are vote-locked can propose updates to the protocol. This can include changing the fees, creating new LPs, adjusting rewards for yield farming and more. The CRV token can be purchased or earned from yield farming after the user deposits assets into LPs. As of April 2023, the token has a circulating supply of 807.69 million and its total supply is 1.9 billion. CRV’s trading volume sits at around $50 million and its max supply is capped at 3.3 million. CRV has quite a few use cases within the Curve Finance ecosystem. Apart from being used as a governance token, it also offers LP rewards and boosts yields. On top of that, it is also used for token burns. Burns are generally used to reduce the circulating supply. They are performed by locking up tokens into a separate, one-way smart contract. The risks of Curve Finance While Curve Finance definitely has plenty of advantages, it is also worth addressing its risks. Fortunately, there are not many of them. The project has been audited by Trail of Bits twice and once by Quantstamp. Of course, this doesn’t mean that the project is risk-free, but it’s a good start. One of the biggest risks that Curve faces is its reliance on other DEFI protocols. As the majority of Curve’s liquidity pools are also supplied by other protocols, to generate additional income. If one of those protocols were to face financial difficulties, there could be a chain reaction that would affect many of them. Does Curve Finance have a future? Curve Finance is one of the most popular AMMs on Ethereum. It facilitates high-volume trades of stablecoins and wrapped cryptocurrencies. It offers tight spreads and low slippage, and numerous DeFi protocols rely heavily on it. As such, it is at the core of Ethereum’s DeFi sector. All of this highly suggests that the project does have a future. There are still risks involved with it, as there are with every crypto project. However, Curve Finance’s chances of remaining popular and operational are still quite good. FAQs What is Curve in crypto? Curve is a decentralized exchange and an AMM protocol that facilitates stablecoin swaps. It also supports swaps of wrapped cryptos. On top of that, it is integrated with a number of other projects in Ethereum’s DeFi sector. How safe is Curve Finance? Curve Finance is as safe as any established cryptocurrency. When dealing with crypto, there are always risks involved. However, the protocol has been audited and is deemed to be a safe platform to use. Who founded Curve Finance? Curve was founded by Michael Egorov. Before founding it, Egorov worked on several other projects in the crypto industry. Is Curve fee free? Curve does not offer zero fees. However, its fees are still quite low in comparison to other similar projects. Is Curve a real bank? Curve Finance is not a bank, but rather a DEX that offers yield farming. Its primary role is to offer stablecoin and wrapped crypto swaps. However, by becoming a liquidity pool provider, you can earn passive income from your dealings with the project.',

'clean_content': '<div><p>Ethereum’s network is the home to a wide range of unique projects. Ever since it created the ERC-20 token model, thousands of tokens have been launched. In time, new products have emerged as well, such as dApps, decentralized finance (DeFi) protocols and decentralized exchanges (DEXes). </p><p>One example of a DEX is Curve Finance, which is Ethereum’s go-to DEX for stablecoin trading. It may not be the largest DEX in Ethereum’s ecosystem, but Curve has certainly left a mark. This guide will explore Curve and explain what it is, how it works and what it has to offer. We will also address the project’s token, CRV, and potential risks of the project.</p><h2>What is Curve Finance?</h2><p>Curve Finance is a decentralized exchange that runs on Ethereum’s network. It specifically functions as a decentralized liquidity pool for stablecoin trading. Unlike other exchanges, it does not use an order book. Instead, it relies on an Automated Market Maker (AMM) model for matching liquidity. </p><p>Curve was founded by Michael Egorov, who previously co-founded the crypto infrastructure protocol NuCypher, where he also served as CTO. He also founded LoanCoin — a decentralized loans networ. Before getting into crypto, he studied at the Moscow Institute of Physics and Technology and the Swinburne University of Technology.</p><p>Curve Finance is very easy to use. All that you need is an Ethereum wallet. Once you have this, you can start swapping different stablecoins at very low trading fees. While Uniswap is Ethereum’s biggest DEX, Curve Finance is still the biggest for stablecoins.</p><h2>What is an AMM?</h2><p>An Automated Market Maker (AMM) is a DEX protocol used for matching liquidity. It’s used by Curve Finance, as well as many other DEXes. Its role is to replace an order book and use a pricing algorithm to price assets. That way, digital assets can be traded using liquidity pools, instead of matching buyers and sellers. </p><h2>How does Curve Finance work?</h2><p>Curve is a fully decentralized and permissionless protocol, run by the Curve DAO. Curve DAO token CRV is used as its native cryptocurrency. Thanks to its decentralized nature, anyone can provide liquidity to one or more pools. Smart contracts are utilized to carry out any swap.</p><p>Smart contracts contain liquidity granted to the DEX by its community. In return, community members receive rewards for offering their tokens. Meanwhile, the tokens are used to match orders submitted to the exchange. By adopting this method, Curve users are able to swap two or more tokens. These swaps can include paired stablecoins or wrapped tokens with the underlying collateral. </p><h2>Stable liquidity pools</h2><p>Curve Finance was launched in 2020 when the decentralized finance sector initially blew up. It emerged with the intention of creating an AMM exchange with low fees and efficient fiat savings accounts. The DEX focuses on stablecoins, which allows investors to avoid some of the more volatile aspects of the crypto industry. Meanwhile, it still allows investors to earn high-interest rates by using lending protocols. </p><h2>Incentives for liquidity providers</h2><p>Since Curve Finance’s model cannot function without liquidity providers, attracting as many as possible is imperative. This is why Curve offers various incentives to its users. For example, Curve Finance offers lower transaction fees in comparison to its competitors such as Uniswap. They also allow users to earn rewards from outside of Curve. This is possible thanks to so-called interoperable tokens. For example, if DAI is lent out on Compound Finance. DAI tokens are then exchanged for cDAI. Curve users can use cDAI in Curve’s own liquidity pools. </p><p>Curve is also integrated with other projects, such as Yearsn and Synthetix. This allows liquidity providers to maximize their return on investment, which in turn, encourages users to return to the platform and provide liquidity to Curve. </p><p>But that’s is not all, as there are more ways to profit from providing liquidity on this platform. These include:</p><ul><li>Trading fees: Liquidity providers earn profits from fees paid by the platform’s traders;</li><li>High APY: Annual Percentage Yields (APY) for stablecoin deposits on Curve can go quite high;</li><li>Yield Farming : Any funds deposited into LPs that end up not being utilized are used in other DeFi protocols for extra income; </li><li>veCRV token: By locking up Curve’s native CRV token, users receive veCRV. After that, veCRV holders can use the tokens to boost their deposit APY even further;</li><li>Boosted pools: Some Curve Finance pools offer further incentives for additional liquidity. This may include high yields for LPs, and Curve is known for yield farming of stablecoins.</li></ul><p>With this at their disposal, Curve liquidity providers can mix and match these income streams how they see fit. It’s in their interest to earn as much as possible in exchange for the use of their tokens.</p><h2>Curve Finance (CRV) token</h2><p>Back in August 2020, Curve Finance began seeking full decentralization through decentralized governance. In order to achieve this, they launched a Decentralized Autonomous Organization, or DAO, for short. Like other DAOs, Curve Finance introduced their native token, CRV.</p><p>Following the launch of CRV, Curve released a distribution schedule that is expected to be completed by 2026. </p><figure><img src="https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/77FafUZE1sjddle2cvbVwT/a02397f818dac7686303ee8da38afad0/Crv.jpg" /></figure><p>The total supply of 3.03b is distributed as such:</p><ul><li>62% to community liquidity providers</li><li>30% to shareholders (team and investors) with 2-4 years vesting</li><li>3% to employees with 2 years vesting</li></ul><p>Curve DAO token, CRV, grants its holders with voting rights, allowing them to vote on various proposals. They can also make proposals themselves, and let the rest of the community vote on it. Anyone with CRV tokens that are vote-locked can propose updates to the protocol. This can include changing the fees, creating new LPs, adjusting rewards for yield farming and more.</p><p>The CRV token can be purchased or earned from yield farming after the user deposits assets into LPs. </p><figure><img src="https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/lWtnJYgt2NuvZ0c841C4k/07de91ea5e7a530dbc006f97dc5a213b/Curve.jpg" /></figure><p>As of April 2023, the token has a circulating supply of 807.69 million and its total supply is 1.9 billion. CRV’s trading volume sits at around $50 million and its max supply is capped at 3.3 million.</p><p>CRV has quite a few use cases within the Curve Finance ecosystem. Apart from being used as a governance token, it also offers LP rewards and boosts yields. On top of that, it is also used for token burns. Burns are generally used to reduce the circulating supply. They are performed by locking up tokens into a separate, one-way smart contract. </p><h2>The risks of Curve Finance</h2><p>While Curve Finance definitely has plenty of advantages, it is also worth addressing its risks. Fortunately, there are not many of them. The project has been audited by Trail of Bits twice and once by Quantstamp. Of course, this doesn’t mean that the project is risk-free, but it’s a good start. </p><p>One of the biggest risks that Curve faces is its reliance on other DEFI protocols. As the majority of Curve’s liquidity pools are also supplied by other protocols, to generate additional income. If one of those protocols were to face financial difficulties, there could be a chain reaction that would affect many of them.</p><h2>Does Curve Finance have a future?</h2><p>Curve Finance is one of the most popular AMMs on Ethereum. It facilitates high-volume trades of stablecoins and wrapped cryptocurrencies. It offers tight spreads and low slippage, and numerous DeFi protocols rely heavily on it. As such, it is at the core of Ethereum’s DeFi sector.</p><p>All of this highly suggests that the project does have a future. There are still risks involved with it, as there are with every crypto project. However, Curve Finance’s chances of remaining popular and operational are still quite good.</p><h2>FAQs</h2><h2>What is Curve in crypto?</h2><p>Curve is a decentralized exchange and an AMM protocol that facilitates stablecoin swaps. It also supports swaps of wrapped cryptos. On top of that, it is integrated with a number of other projects in Ethereum’s DeFi sector.</p><h2>How safe is Curve Finance?</h2><p>Curve Finance is as safe as any established cryptocurrency. When dealing with crypto, there are always risks involved. However, the protocol has been audited and is deemed to be a safe platform to use.</p><h2>Who founded Curve Finance?</h2><p>Curve was founded by Michael Egorov. Before founding it, Egorov worked on several other projects in the crypto industry. </p><h2>Is Curve fee free?</h2><p>Curve does not offer zero fees. However, its fees are still quite low in comparison to other similar projects.</p><h2>Is Curve a real bank?</h2><p>Curve Finance is not a bank, but rather a DEX that offers yield farming. Its primary role is to offer stablecoin and wrapped crypto swaps. However, by becoming a liquidity pool provider, you can earn passive income from your dealings with the project.</p></div>',

'content_list': [{'type': 'text',

'data': 'Ethereum’s network is the home to a wide range of unique projects. Ever since it created the ERC-20 token model, thousands of tokens have been launched. In time, new products have emerged as well, such as dApps, decentralized finance (DeFi) protocols and decentralized exchanges (DEXes).',

'caption': ''},

{'type': 'text',

'data': 'One example of a DEX is Curve Finance, which is Ethereum’s go-to DEX for stablecoin trading. It may not be the largest DEX in Ethereum’s ecosystem, but Curve has certainly left a mark. This guide will explore Curve and explain what it is, how it works and what it has to offer. We will also address the project’s token, CRV, and potential risks of the project.',

'caption': ''},

{'type': 'text', 'data': 'What is Curve Finance?', 'caption': ''},

{'type': 'text',

'data': 'Curve Finance is a decentralized exchange that runs on Ethereum’s network. It specifically functions as a decentralized liquidity pool for stablecoin trading. Unlike other exchanges, it does not use an order book. Instead, it relies on an Automated Market Maker (AMM) model for matching liquidity.',

'caption': ''},

{'type': 'text',

'data': 'Curve was founded by Michael Egorov, who previously co-founded the crypto infrastructure protocol NuCypher, where he also served as CTO. He also founded LoanCoin — a decentralized loans networ. Before getting into crypto, he studied at the Moscow Institute of Physics and Technology and the Swinburne University of Technology.',

'caption': ''},

{'type': 'text',

'data': 'Curve Finance is very easy to use. All that you need is an Ethereum wallet. Once you have this, you can start swapping different stablecoins at very low trading fees. While Uniswap is Ethereum’s biggest DEX, Curve Finance is still the biggest for stablecoins.',

'caption': ''},

{'type': 'text', 'data': 'What is an AMM?', 'caption': ''},

{'type': 'text',

'data': 'An Automated Market Maker (AMM) is a DEX protocol used for matching liquidity. It’s used by Curve Finance, as well as many other DEXes. Its role is to replace an order book and use a pricing algorithm to price assets. That way, digital assets can be traded using liquidity pools, instead of matching buyers and sellers.',

'caption': ''},

{'type': 'text', 'data': 'How does Curve Finance work?', 'caption': ''},

{'type': 'text',

'data': 'Curve is a fully decentralized and permissionless protocol, run by the Curve DAO. Curve DAO token CRV is used as its native cryptocurrency. Thanks to its decentralized nature, anyone can provide liquidity to one or more pools. Smart contracts are utilized to carry out any swap.',

'caption': ''},

{'type': 'text',

'data': 'Smart contracts contain liquidity granted to the DEX by its community. In return, community members receive rewards for offering their tokens. Meanwhile, the tokens are used to match orders submitted to the exchange. By adopting this method, Curve users are able to swap two or more tokens. These swaps can include paired stablecoins or wrapped tokens with the underlying collateral.',

'caption': ''},

{'type': 'text', 'data': 'Stable liquidity pools', 'caption': ''},

{'type': 'text',

'data': 'Curve Finance was launched in 2020 when the decentralized finance sector initially blew up. It emerged with the intention of creating an AMM exchange with low fees and efficient fiat savings accounts. The DEX focuses on stablecoins, which allows investors to avoid some of the more volatile aspects of the crypto industry. Meanwhile, it still allows investors to earn high-interest rates by using lending protocols.',

'caption': ''},

{'type': 'text',

'data': 'Incentives for liquidity providers',

'caption': ''},

{'type': 'text',

'data': 'Since Curve Finance’s model cannot function without liquidity providers, attracting as many as possible is imperative. This is why Curve offers various incentives to its users. For example, Curve Finance offers lower transaction fees in comparison to its competitors such as Uniswap. They also allow users to earn rewards from outside of Curve. This is possible thanks to so-called interoperable tokens. For example, if DAI is lent out on Compound Finance. DAI tokens are then exchanged for cDAI. Curve users can use cDAI in Curve’s own liquidity pools.',

'caption': ''},

{'type': 'text',

'data': 'Curve is also integrated with other projects, such as Yearsn and Synthetix. This allows liquidity providers to maximize their return on investment, which in turn, encourages users to return to the platform and provide liquidity to Curve.',

'caption': ''},

{'type': 'text',

'data': 'But that’s is not all, as there are more ways to profit from providing liquidity on this platform. These include:',

'caption': ''},

{'type': 'text',

'data': 'Trading fees: Liquidity providers earn profits from fees paid by the platform’s traders;',

'caption': ''},

{'type': 'text',

'data': 'High APY: Annual Percentage Yields (APY) for stablecoin deposits on Curve can go quite high;',

'caption': ''},

{'type': 'text',

'data': 'Yield Farming : Any funds deposited into LPs that end up not being utilized are used in other DeFi protocols for extra income;',

'caption': ''},

{'type': 'text',

'data': 'veCRV token: By locking up Curve’s native CRV token, users receive veCRV. After that, veCRV holders can use the tokens to boost their deposit APY even further;',

'caption': ''},

{'type': 'text',

'data': 'Boosted pools: Some Curve Finance pools offer further incentives for additional liquidity. This may include high yields for LPs, and Curve is known for yield farming of stablecoins.',

'caption': ''},

{'type': 'text',

'data': 'With this at their disposal, Curve liquidity providers can mix and match these income streams how they see fit. It’s in their interest to earn as much as possible in exchange for the use of their tokens.',

'caption': ''},

{'type': 'text', 'data': 'Curve Finance (CRV) token', 'caption': ''},

{'type': 'text',

'data': 'Back in August 2020, Curve Finance began seeking full decentralization through decentralized governance. In order to achieve this, they launched a Decentralized Autonomous Organization, or DAO, for short. Like other DAOs, Curve Finance introduced their native token, CRV.',

'caption': ''},

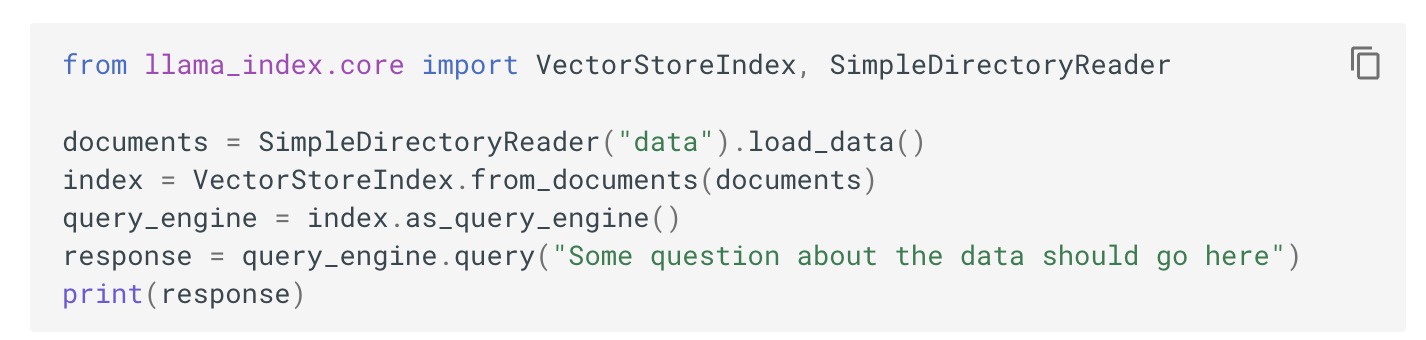

{'type': 'text',

'data': 'Following the launch of CRV, Curve released a distribution schedule that is expected to be completed by 2026.',

'caption': ''},

{'type': 'image',

'data': 'https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/77FafUZE1sjddle2cvbVwT/a02397f818dac7686303ee8da38afad0/Crv.jpg',

'caption': ''},

{'type': 'text',

'data': 'The total supply of 3.03b is distributed as such:',

'caption': ''},

{'type': 'text',

'data': '62% to community liquidity providers',

'caption': ''},

{'type': 'text',

'data': '30% to shareholders (team and investors) with 2-4 years vesting',

'caption': ''},

{'type': 'text',

'data': '3% to employees with 2 years vesting',

'caption': ''},

{'type': 'text',

'data': 'Curve DAO token, CRV, grants its holders with voting rights, allowing them to vote on various proposals. They can also make proposals themselves, and let the rest of the community vote on it. Anyone with CRV tokens that are vote-locked can propose updates to the protocol. This can include changing the fees, creating new LPs, adjusting rewards for yield farming and more.',

'caption': ''},

{'type': 'text',

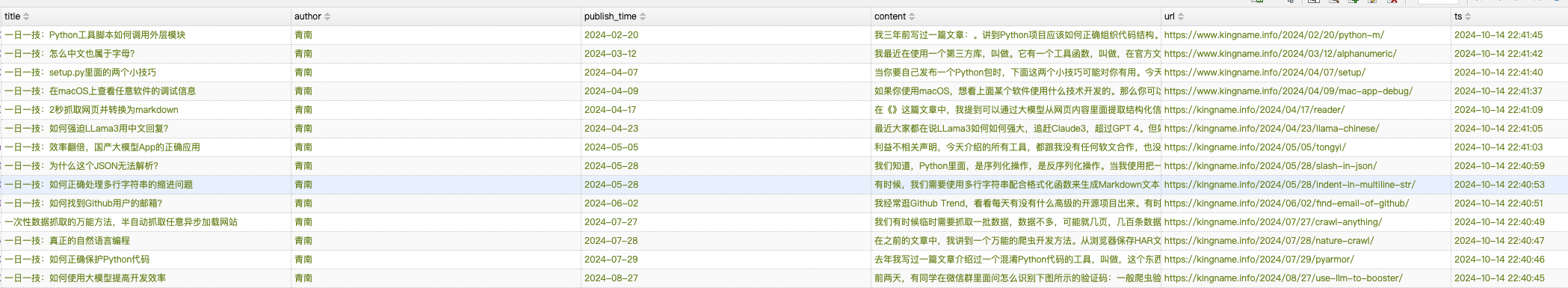

'data': 'The CRV token can be purchased or earned from yield farming after the user deposits assets into LPs.',

'caption': ''},

{'type': 'image',

'data': 'https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/lWtnJYgt2NuvZ0c841C4k/07de91ea5e7a530dbc006f97dc5a213b/Curve.jpg',

'caption': ''},

{'type': 'text',

'data': 'As of April 2023, the token has a circulating supply of 807.69 million and its total supply is 1.9 billion. CRV’s trading volume sits at around $50 million and its max supply is capped at 3.3 million.',

'caption': ''},

{'type': 'text',

'data': 'CRV has quite a few use cases within the Curve Finance ecosystem. Apart from being used as a governance token, it also offers LP rewards and boosts yields. On top of that, it is also used for token burns. Burns are generally used to reduce the circulating supply. They are performed by locking up tokens into a separate, one-way smart contract.',

'caption': ''},

{'type': 'text', 'data': 'The risks of Curve Finance', 'caption': ''},

{'type': 'text',

'data': 'While Curve Finance definitely has plenty of advantages, it is also worth addressing its risks. Fortunately, there are not many of them. The project has been audited by Trail of Bits twice and once by Quantstamp. Of course, this doesn’t mean that the project is risk-free, but it’s a good start.',

'caption': ''},

{'type': 'text',

'data': 'One of the biggest risks that Curve faces is its reliance on other DEFI protocols. As the majority of Curve’s liquidity pools are also supplied by other protocols, to generate additional income. If one of those protocols were to face financial difficulties, there could be a chain reaction that would affect many of them.',

'caption': ''},

{'type': 'text', 'data': 'Does Curve Finance have a future?', 'caption': ''},

{'type': 'text',

'data': 'Curve Finance is one of the most popular AMMs on Ethereum. It facilitates high-volume trades of stablecoins and wrapped cryptocurrencies. It offers tight spreads and low slippage, and numerous DeFi protocols rely heavily on it. As such, it is at the core of Ethereum’s DeFi sector.',

'caption': ''},

{'type': 'text',

'data': 'All of this highly suggests that the project does have a future. There are still risks involved with it, as there are with every crypto project. However, Curve Finance’s chances of remaining popular and operational are still quite good.',

'caption': ''},

{'type': 'text', 'data': 'FAQs', 'caption': ''},

{'type': 'text', 'data': 'What is Curve in crypto?', 'caption': ''},

{'type': 'text',

'data': 'Curve is a decentralized exchange and an AMM protocol that facilitates stablecoin swaps. It also supports swaps of wrapped cryptos. On top of that, it is integrated with a number of other projects in Ethereum’s DeFi sector.',

'caption': ''},

{'type': 'text', 'data': 'How safe is Curve Finance?', 'caption': ''},

{'type': 'text',

'data': 'Curve Finance is as safe as any established cryptocurrency. When dealing with crypto, there are always risks involved. However, the protocol has been audited and is deemed to be a safe platform to use.',

'caption': ''},

{'type': 'text', 'data': 'Who founded Curve Finance?', 'caption': ''},

{'type': 'text',

'data': 'Curve was founded by Michael Egorov. Before founding it, Egorov worked on several other projects in the crypto industry.',

'caption': ''},

{'type': 'text', 'data': 'Is Curve fee free?', 'caption': ''},

{'type': 'text',

'data': 'Curve does not offer zero fees. However, its fees are still quite low in comparison to other similar projects.',

'caption': ''},

{'type': 'text', 'data': 'Is Curve a real bank?', 'caption': ''},

{'type': 'text',

'data': 'Curve Finance is not a bank, but rather a DEX that offers yield farming. Its primary role is to offer stablecoin and wrapped crypto swaps. However, by becoming a liquidity pool provider, you can earn passive income from your dealings with the project.',

'caption': ''}],

'summary': 'Ethereum’s network is the home to a wide range of unique projects. Ever since it created the ERC-20 token model, thousands of tokens have been launched. In time, new products have emerged as well, such as dApps, decentralized finance (DeFi) protocols and decentralized exchanges (DEXes). One example of a...',

'canonical_url': 'https://www.okx.com/learn/curve-finance-guide',

'image_count': 2,

'image_urls': ['https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/77FafUZE1sjddle2cvbVwT/a02397f818dac7686303ee8da38afad0/Crv.jpg',

'https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/lWtnJYgt2NuvZ0c841C4k/07de91ea5e7a530dbc006f97dc5a213b/Curve.jpg'],

'image_captions': ['', ''],

'head_meta': {'og:type': 'article',

'description': 'Ethereum’s network is the home',

'og:description': '',

'twitter:image': 'https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/56aHhyers8WrWwWSE6M0x3/5c15ce05044a4cfa63f86453cbf86e35/MP_Cover.png',

'viewport': 'width=device-width, initial-scale=1.0, maximum-scale=1.0, minimum-scale=1.0, user-scalable=no',

'Author': 'OKX',

'og:site_name': 'OKX',

'keywords': 'BTC, BTC trading platform, ETH, EOS, Qtum, NEO, Ripple, BTC price, LTC, BCH, ETC, Blockchain',

'og:image': 'https://static.okx.com/cdn/assets/plugins/contentful/4nqoo8goeymu/56aHhyers8WrWwWSE6M0x3/5c15ce05044a4cfa63f86453cbf86e35/MP_Cover.png',

'browsermode': 'application',

'og:locale': 'en_US',

'twitter:site': '@okx',

'og:url': 'https://www.okx.com/learn/curve-finance-guide',

'og:title': 'Exploring Curve Finance: A comprehensive guide',

'x5-orientation': 'portrait',

'x5-page-mode': 'app',

'google-site-verification': 'SVJL-WGbe8_1J05O3I8V4ehAs8L89UDA-bcAyAJ2SLw',

'full-screen': 'yes',

'twitter:title': 'Exploring Curve Finance: A comprehensive guide',

'twitter:card': 'summary_large_image',

'apple-mobile-web-app-capable': 'yes',

'x5-fullscreen': 'true',

'Copyright': 'okx.com',

'twitter:description': 'Ethereum’s network is the home'},

'author': ['OKX'],

'timezone': '',

'url': 'https://www.okx.com/learn/curve-finance-guide',

'amp_url': '',

'breadcrumb': [{'level': 0,

'text': 'Learn',

'link': 'https://www.okx.com/learn'},

{'level': 1,

'text': 'Glossary',

'link': 'https://www.okx.com/learn/category/blockchain-glossary'},

{'level': 2, 'text': 'Article', 'link': ''}]}

|

![]()

![]()