拒绝“偷天换日”!深度拆解 Go sumdb 的密码学防线

![]()

本文永久链接 – https://tonybai.com/2026/03/14/go-sumdb-transparent-logs-supply-chain-trust

大家好,我是Tony Bai。

在 Go 语言的日常开发中,go get 是我们最熟悉的命令之一。我们理所当然地认为,只要指定了版本号,从 GitHub 或其他代码托管平台拉取下来的代码就是安全、一致的。然而,现实却远比这脆弱——Git 的 Tag 是可变的。攻击者可以发布一个带有后门的 v1.2.3 版本,在诱导受害者下载后,再通过 Force-push 将其替换为干净的代码,从而在代码审查的眼皮底下“瞒天过海”。

为了应对这种极其隐蔽的软件供应链攻击,Go 团队祭出了其包管理生态中的终极武器:Go Checksum Database (sumdb)。但很多Go开发者并不清楚Go sumdb背后的工作机制。 本文将结合 Russ Cox 和 Filippo Valsorda 的核心设计文档,拆解一下 sumdb 究竟是如何利用透明日志(Transparent Logs)和精妙的瓦片化(Tiling)算法,在不信任任何中央服务器的前提下,为全球 Go 开发者构筑起一道坚不可摧的密码学防线的。

![]()

TOFU 困境与“多疑的客户端”

自 Go 1.11 引入 Modules 以来,go.sum 文件成为了每个项目不可或缺的部分。它记录了依赖包的预期加密哈希值。只要 go.sum 存在,明天下载的代码就必须和今天一模一样。

但这带来了一个经典的密码学难题:TOFU(Trust On First Use,首次使用时信任)。

当你在项目中第一次引入某个第三方包时,本地没有它的哈希记录。此时 go 命令只能“盲目”去源站(一般是github)下载,计算哈希并写入 go.sum。如果恰好在这一次下载时网络被劫持,或者作者刚好推送了恶意代码,那么恶意代码的哈希就会被“合法化”并永久记录在你的项目中。

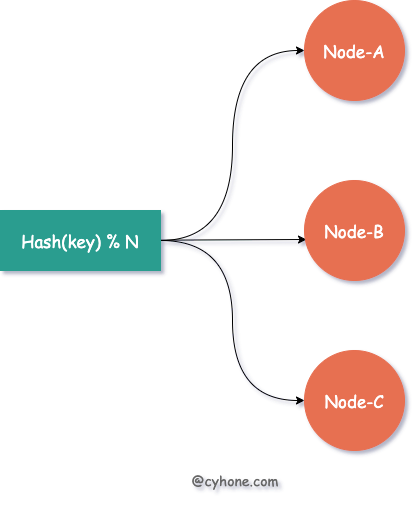

为了解决 TOFU 问题,Go 官方设立了 sum.golang.org,一个记录全球所有公开 Go 模块版本哈希的中央校验和数据库。

但是,新的问题随之而来:如果连 Google 运营的这个中央数据库也被黑客攻破了呢?或者如果服务器故意向特定用户返回伪造的哈希值呢?

Go 团队的答案是:设计一个“多疑的客户端”。go 命令绝不盲目信任 sumdb 服务器返回的任何一条数据,而是要求服务器提供严密的数学证明。这套证明体系的基石,就是 透明日志(Transparent Logs)。

核心底座:透明日志(Transparent Logs)深度解析

透明日志本质上是一个只追加(Append-Only)的防篡改数据结构,其核心是默克尔树(Merkle Tree)。在 sumdb/tlog/tlog.go 源码中,我们可以清晰地看到这棵树的构建过程。

树的构建与防碰撞设计

透明日志将每一个模块的版本和哈希记录作为树的叶子节点。两两相邻的叶子节点哈希相加,生成父节点的哈希,层层向上,最终生成一个唯一的树根哈希(Tree Hash)。

为了防止经典的“第二原像攻击”(即攻击者构造一个叶子节点,使其哈希值碰巧等于某个内部节点的哈希值),tlog.go 在计算哈希时进行了极其严谨的域隔离(Domain Separation)前缀设计:

// 源码文件:sumdb/tlog/tlog.go

// 计算叶子节点(Record)哈希,前缀加 0x00

func RecordHash(data []byte) Hash {

h := sha256.New()

h.Write([]byte{0x00}) // RFC 6962: SHA256(0x00 || data)

h.Write(data)

// ...

}

// 计算内部节点哈希,前缀加 0x01

func NodeHash(left, right Hash) Hash {

var buf[1 + HashSize + HashSize]byte

buf[0] = 0x01 // RFC 6962: SHA256(0x01 || left || right)

copy(buf[1:], left[:])

copy(buf[1+HashSize:], right[:])

return sha256.Sum256(buf[:])

}

这个唯一的树根哈希代表了此刻全球 Go 生态所有公开包的完整历史状态。任何一个历史字节的篡改,都会导致根哈希发生雪崩式的变化。

存在性证明

当客户端向 sumdb 查询 rsc.io/quote@v1.5.2 时,服务器不仅返回记录,还会返回一条证明路径。

![]()

如上图所示,如果客户端想验证黄绿色的 Record 1 是否在树中,服务器只需提供旁边黄色的节点(Record 0 和 Node Hash L1-1)的哈希值。客户端在本地通过 NodeHash(RecordHash(Record 1), Record 0) 计算出 N1,再与 N2 结合计算出 Root。

如果计算出的 Root 与官方公布的根哈希一致,这在数学上就绝对证明了:该模块的哈希确实被官方收录,绝无伪造可能。 这一过程的时间复杂度仅为 O(log N)。

一致性证明

这是防止服务器“撒谎”的终极杀手锏。

如果 sumdb 服务器被黑客控制,黑客针对“受害者 A”返回一棵包含后门记录的“伪造树”,而对其他用户返回“正常树”(这种攻击被称为 Fork Attack)。该如何防范?

客户端在每次成功通信后,都会将当前的树大小(N)和根哈希(T)持久化在本地(通常位于 $GOPATH/pkg/sumdb/sum.golang.org/latest)。

下一次通信时,如果服务器声称树长大了(规模变为 N’,新哈希为 T’),客户端会要求服务器出具一致性证明。客户端通过比对两条证明路径,在本地强校验:新的树 T’,是否完美且完整地包含了旧树 T 的所有历史记录?

如果历史被重写,一致性校验必将失败。客户端会立即阻断构建,并抛出带有详细密码学证据的 SECURITY ERROR。

工程奇迹:瓦片化(Tiling)算法

理论虽然完美,但落地面临着巨大的工程挑战:全球几百万 Go 开发者,每次 go get 都要向中央服务器请求动态计算的 Merkle Tree 证明,服务器算力绝对会瞬间崩溃。此外,动态生成的证明根本无法被 CDN 缓存。

为了解决这个问题,Russ Cox 引入了一项堪称艺术的设计:日志瓦片化(Tiling a Log)。

参考 Google Maps 将全球地图切分为静态切片(Tiles)的思路,sumdb 没有提供动态计算的证明 API,而是将整棵庞大的哈希树,按照固定的高度(默认 Height = 8)切分成了无数的静态“瓦片”。

![]()

在 sumdb/tlog/tile.go 源码中,每个 Tile 都有一个三维坐标 tile/H/L/N:

- H (Height): 瓦片高度(默认为 8,即每个瓦片最多包含 $2^8 = 256$ 个哈希值)。

- L (Level): 瓦片在树中的层级。

- N (Number): 瓦片的水平索引。

瓦片化带来的工程收益是巨大的:

- 动态变静态:服务器只需不断生成包含哈希值的静态二进制文件,不需要消耗 CPU 动态计算证明。

- 极度缓存友好:一旦某个瓦片被填满(存满 256 个哈希),它就永远不再变化。这意味着 CDN 边缘节点、企业内部代理(如 Athens、Goproxy.cn)可以永久缓存这些瓦片。超过 99% 的 sumdb 请求直接命中缓存,根本不会打到 Google 的源站。

- 宽带极度节省:一个高度为 8 的完整哈希瓦片只有 8KB 大小。客户端下载几个静态瓦片,就可以在本地内存中拼装出任意所需的证明路径。

源码追踪:go get 的隐秘战线

当我们在命令行敲下 go get 时,底层到底发生了什么?翻开 sumdb/client.go 的源码,我们可以看到严密的防御逻辑:

-

获取最新签名树头:

客户端首先请求 /latest 接口。服务器返回由官方 Ed25519 密钥签名的树大小和根哈希。

客户端使用 sumdb/note 包(基于加盐哈希和 Base64)验证签名的合法性。 -

查询模块位置(Lookup):

执行 Client.Lookup(“rsc.io/quote”, “v1.5.2″)。向服务器请求 /lookup/rsc.io/quote@v1.5.2,服务器返回该模块在日志中的记录编号(Record ID)以及该记录的文本内容。 -

下载瓦片并行验证(Read and Verify Tiles):

客户端利用记录编号,推算出需要哪些瓦片才能构建从叶子节点到根哈希的证明路径(在 tileHashReader.ReadHashes 中实现)。

客户端并行下载缺失的静态瓦片文件 /tile/8/0/x001 等,并在本地执行 tlog.ProveRecord 和 tlog.ProveTree 进行存在性和一致性校验。 -

安全落地(Merge & Write):

// 源码片段:sumdb/client.go if err := c.checkRecord(id, text); err != nil { return cached{nil, err} // 存在性校验失败 } if err := c.mergeLatest(treeMsg); err != nil { return cached{nil, err} // 一致性校验失败 (防 Fork 攻击) }只有当数学证明完全成立时,go 命令才会将该模块的哈希写入你本地项目的 go.sum 文件中,并将其缓存,供后续使用。

跨界延伸:透明日志还能用在哪里?

透明日志机制并非 Go 语言独享,它是现代数字信任体系的基石架构。除了保护 Go 的供应链,它还在以下领域发挥着无可替代的作用:

- 证书透明度 (Certificate Transparency, CT):

这是透明日志最著名的大规模应用。Google Chrome 强制要求全球所有受信任的证书颁发机构(CA)必须将颁发的 TLS/SSL 证书记录到公共的透明日志中,以防止恶意 CA 伪造域名证书。sumdb包源码中的 tlog.go 中甚至包含了直接解析 CT 日志结构(RFC 6962)的测试代码。 - 二进制透明度与 Sigstore (Binary Transparency):

开源界防范供应链攻击的明星项目 Sigstore (Rekor) 同样基于透明日志构建。它用于记录软件构件(如 Docker 镜像、二进制可执行文件)的签名活动,确保构建产物不被掉包。 - 防篡改金融账本与可信审计:

任何需要解决“事后抵赖”和“选择性欺骗”的系统——如电子投票、金融交易核心流水、甚至区块链的 Layer2 状态提交——都可以利用透明日志(Append-only + Merkle Proof)来保证数据的永恒性和不可否认性。

小结:看不见的盾牌

在这个充满漏洞和供应链投毒的黑暗森林里,Go 语言之所以能成为安全开发的避风港,绝不仅仅是因为静态类型或内存安全。

sumdb 的设计展现了 Go 核心团队的高超的工程智慧:他们不强求开发者去信任任何外部服务器(甚至是他们自己运营的服务器),而是将信任建立在严密的代码、数学逻辑和密码学证明之上。

当你的屏幕上飞速闪过 go get 的进度条,并在零点几秒内完成构建时,请记住:你的本地机器刚刚与全球见证的密码学巨树完成了一次无声的灵魂校验。

参考资料

- https://go.googlesource.com/proposal/+/master/design/25530-sumdb.md

- https://research.swtch.com/tlog

- https://pkg.go.dev/go.transparencylog.com/mod/sumdb

你信任你的 Proxy 吗?

密码学的魅力在于“不信任任何人,只信任数学”。在你的日常开发中,你是否曾遭遇过依赖包版本冲突或疑似被“掉包”的经历?你认为透明日志这种机制,是否应该成为所有包管理器的标配?

欢迎在评论区分享你的供应链安全感悟!

还在为“复制粘贴喂AI”而烦恼?我的新专栏 《AI原生开发工作流实战》 将带你:

- 告别低效,重塑开发范式

- 驾驭AI Agent(Claude Code),实现工作流自动化

- 从“AI使用者”进化为规范驱动开发的“工作流指挥家”

扫描下方二维码,开启你的AI原生开发之旅。

![]()

你的Go技能,是否也卡在了“熟练”到“精通”的瓶颈期?

- 想写出更地道、更健壮的Go代码,却总在细节上踩坑?

- 渴望提升软件设计能力,驾驭复杂Go项目却缺乏章法?

- 想打造生产级的Go服务,却在工程化实践中屡屡受挫?

继《Go语言第一课》后,我的《Go语言进阶课》终于在极客时间与大家见面了!

我的全新极客时间专栏 《Tony Bai·Go语言进阶课》就是为这样的你量身打造!30+讲硬核内容,带你夯实语法认知,提升设计思维,锻造工程实践能力,更有实战项目串讲。

目标只有一个:助你完成从“Go熟练工”到“Go专家”的蜕变! 现在就加入,让你的Go技能再上一个新台阶!

![]()

商务合作方式:撰稿、出书、培训、在线课程、合伙创业、咨询、广告合作。如有需求,请扫描下方公众号二维码,与我私信联系。

![]()

© 2026, bigwhite. 版权所有.